让每一项优秀工作,被更多人看见:点击进入投稿通道

-

论文标题:Sparse but Critical: A Token-Level Analysis of Distributional Shifts in RLVR Fine-Tuning of LLMs

-

论文链接:https://arxiv.org/pdf/2603.22446

TL;DR

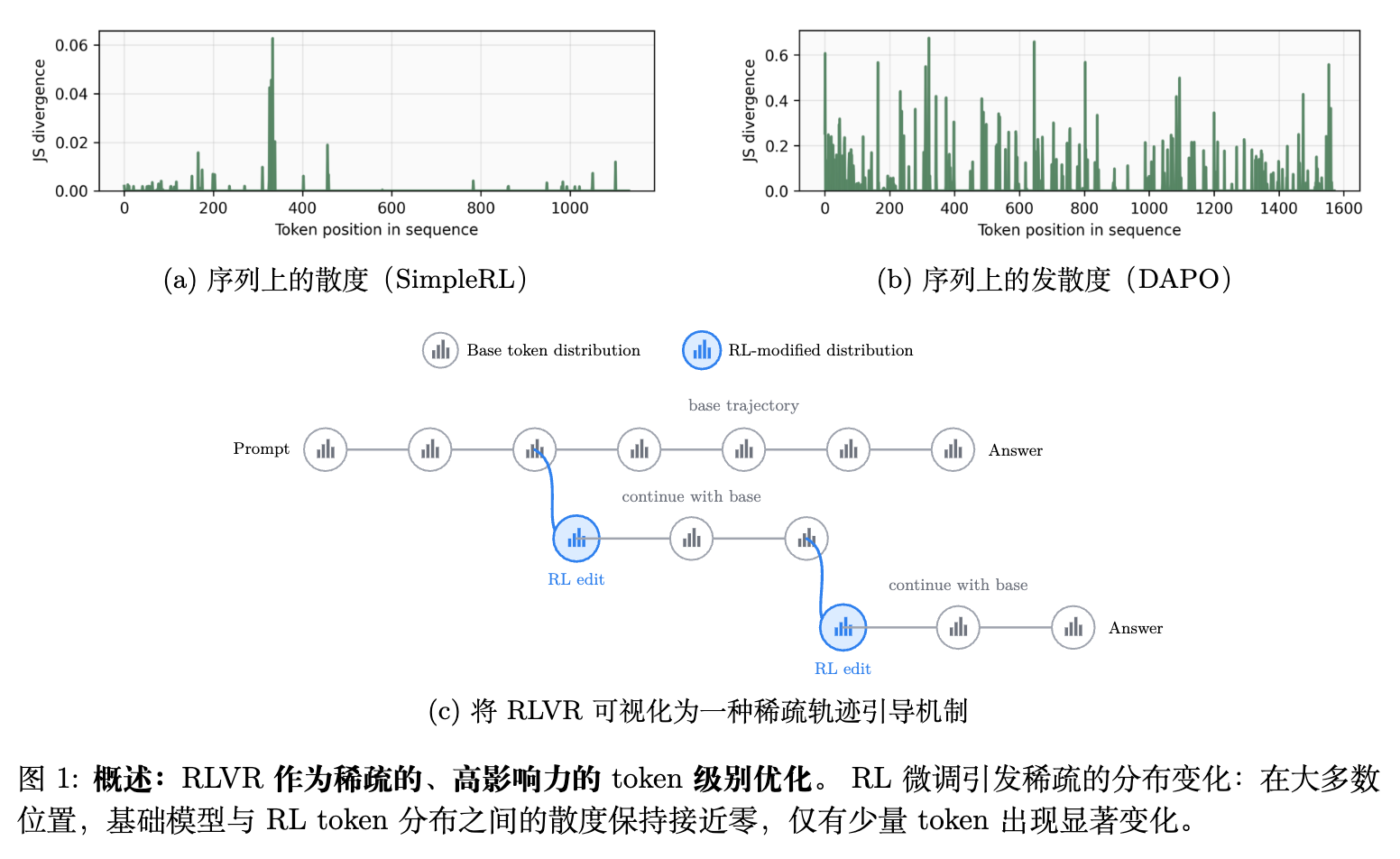

今天解读一篇来自Qwen团队的论文《Sparse but Critical: A Token-Level Analysis of Distributional Shifts in RLVR Fine-Tuning of LLMs》。该研究将评估视角从传统的响应级别(如准确率、奖励得分)下沉至词元(Token)级别的预测分布,系统分析了带有可验证奖励的强化学习(RLVR)是如何改变基础语言模型(Base LLM)的内在行为的。

研究核心结论表明:

-

分布偏移的稀疏性:RLVR 引起的词元级别分布偏移具有显著的稀疏性。在绝大多数生成步骤中,强化学习模型与基础模型的预测分布近乎一致,仅在少部分特定位置出现明显的发散。 -

少部分词元决定整体性能:通过设计交叉采样(Cross-Sampling)实验证明,仅替换轨迹中一小部分高散度词元,即可在基础模型上恢复 RLVR 的性能增益,或在 RL 模型上消除这些增益。 -

重排序而非创新:在出现较大分布变化的词元位置,RLVR 主要是在基础模型原有的候选词元集合内进行概率重分配和排序调整,较少提升原本在基础模型中处于低概率尾部的词元。 -

散度加权优势:基于上述稀疏性观察,研究测试了基于散度加权的优势函数(Divergence-Weighted Advantage),表明在词元级别依据分布散度调整学习信号能够对训练产生正向影响。

1. 引言

大语言模型(LLMs)在复杂推理和数学基准测试上的能力提升,在较大程度上得益于带有可验证奖励的强化学习(Reinforcement Learning with Verifiable Rewards, RLVR)技术的应用。以 GRPO(Group Relative Policy Optimization)为代表的算法,通过在生成的推理轨迹上应用可验证的客观奖励,实现了模型性能的提升。

然而,现有对 RLVR 微调的评估大多集中在聚合的响应级别指标上,例如最终答案的准确率、平均奖励值或响应长度。这类宏观指标能够反映模型是否变好,但无法解释模型行为是如何发生改变的。一个尚未被彻底解析的底层问题是:RLVR 究竟是如何重塑基础模型的词元级别预测分布的?在这些分布变化中,又是哪些具体的变化真正驱动了下游推理性能的提升?

近期的一些研究开始从词元级别的熵和不确定性角度分析 RL 微调,关注高熵词元以及探索动态的作用。同时,也有研究通过词元级别 KL 散度和排名偏移统计来分析 RL 引起的变化。本论文在此基础上,建立了一个系统且细粒度的词元级别分布偏移分析框架。论文关注的核心不仅仅是变化发生的位置和幅度,更包括概率质量如何在候选词元间重新分配、这些变化在训练过程中的演进轨迹,以及它们对整体推理性能的功能性影响程度。

2. 预备知识与研究设置

为了量化和分析分布差异,研究将被 RL 优化后的模型生成的轨迹视为参考路径,并在此相同的上下文序列下,逐个词元比较基础模型与 RL 模型的条件分布。

2.1 词元分布差异的数学定义

对于每一个词元位置 及其前缀上下文 ,令 和 分别表示基础模型和 RL 模型在词表空间 上的条件下一个词元分布。

为了量化这两个分布之间的差异,研究采用了 Jensen-Shannon (JS) 散度。其定义如下:

其中,混合分布 为两个分布的平均值:

研究选择 JS 散度而非传统的 KL 散度,原因在于:

-

对称性:JS 散度是对称的,无需考虑方向性问题。 -

有界性:JS 散度的值域被限制在 之间,这避免了在计算聚合统计量时被少数极端值主导。 -

绝对连续性要求低:当两个概率测度之间缺乏绝对连续性时,JS 散度依然有明确的数学定义。这在实际操作中较为关键,因为出于显存限制,往往需要对分布进行截断(例如 top- 采样),此时 KL 散度可能会因为分母为零而出现无定义的情况。

除特殊说明外,研究中的散度计算均基于与生成阶段相同的 top- 截断分布,而熵和概率则基于完整的估计分布计算。这样可以保证散度能够反映实际采样机制下的有效差异,同时又能准确体现模型对完整词表的置信度。

2.2 模型与数据集设置

研究主要基于 Qwen2.5-32B 作为基础模型。RLVR 变体主要使用两种训练策略:

-

SimpleRL:采用基础的 RL 设置。 -

DAPO(Decoupled Clip and Dynamic sAmpling Policy Optimization):引入了非对称的 clip-higher 机制、动态采样和词元级平均。

评估数据集主要使用 AIME 2024 和 AIME 2025(每个问题采样 32 个响应以确保统计稳健性)。为了验证结论的普适性,研究还扩展分析了 Qwen2.5-Math-7B(对比不同上界裁剪参数)、Qwen3-8B-Base 以及 Mistral-Small-24B 模型,并涉及 AMC、GPQA 等基准测试。

3. 分布偏移的全局特征

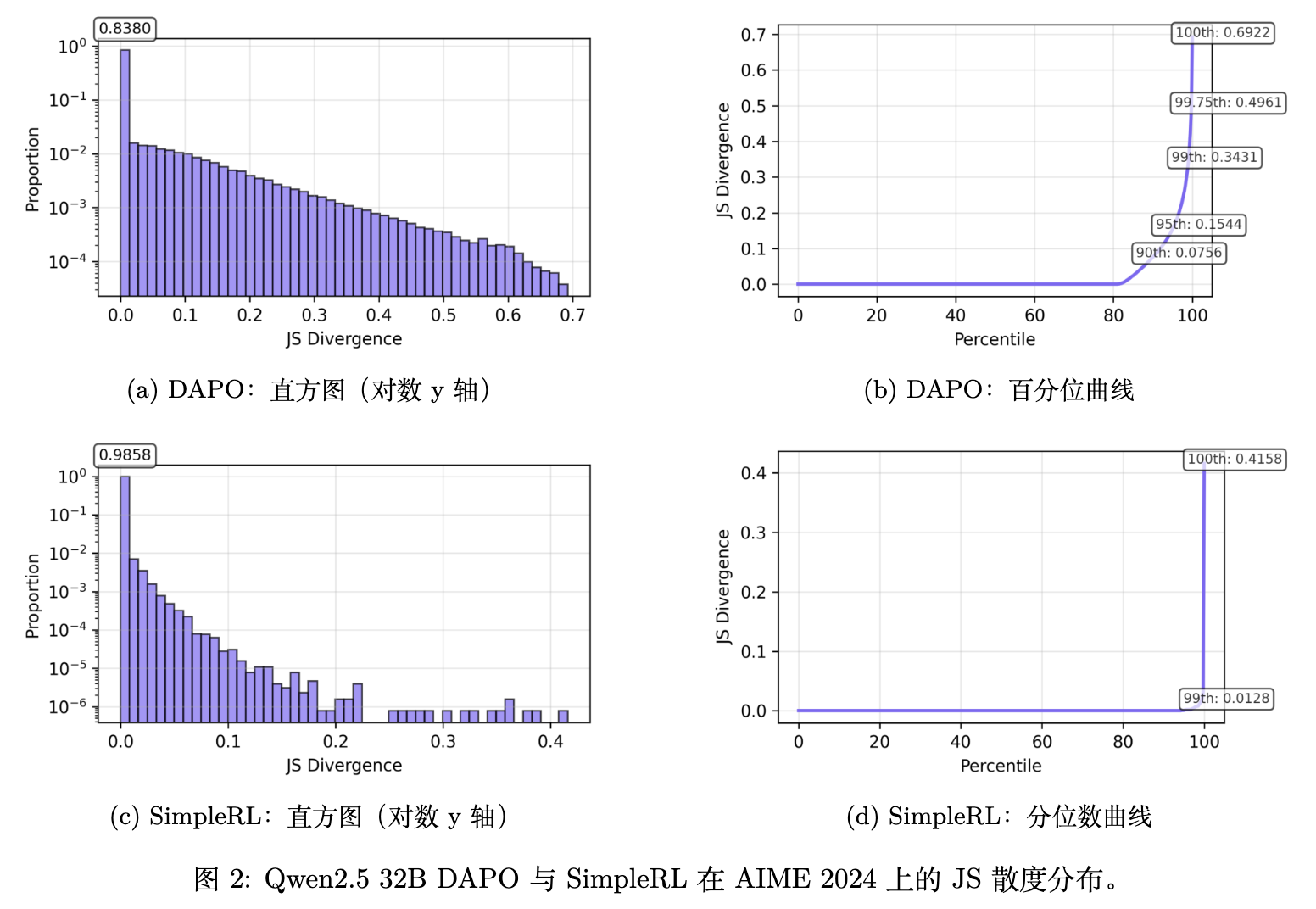

为了理解 RLVR 引起的分布变化在整个词元序列中的散布情况,研究首先绘制了 JS 散度的直方图和百分位数曲线。

3.1 分布偏移呈现高度稀疏性

通过观察 JS 散度的分布图可以发现,RLVR 的优化在词元分布层面上呈现高度的稀疏性。

在 DAPO 模型的生成序列中,超过 83% 的词元位置表现出接近于零的 JS 散度;而在 SimpleRL 模型中,这一比例甚至超过了 98%。直方图在零值处的明显尖峰以及百分位数曲线的陡峭上升,表明仅有一小部分词元位置经历了实质性的分布调整。

对比 DAPO 和 SimpleRL,DAPO 展现出相对更宽的散度分布和更平缓的百分位数曲线。这与其采用的 clip-higher 机制(允许更高程度的探索更新)以及缺乏 KL 正则化有关。SimpleRL 施加了更严格的约束,导致分布变化更为集中。不过,即使 DAPO 去除了 KL 正则化,其策略仍能在绝大多数词元分布上保持与基础模型的近乎一致。

在 Qwen2.5-Math-7B 上的控制实验表明,收紧 upper clip(从 0.28 降至 0.2)会导致分布偏移变得更加稀疏。clip-higher 机制允许更广泛的高散度词元分布存在,但在极端值处的散度幅度会有所降低。

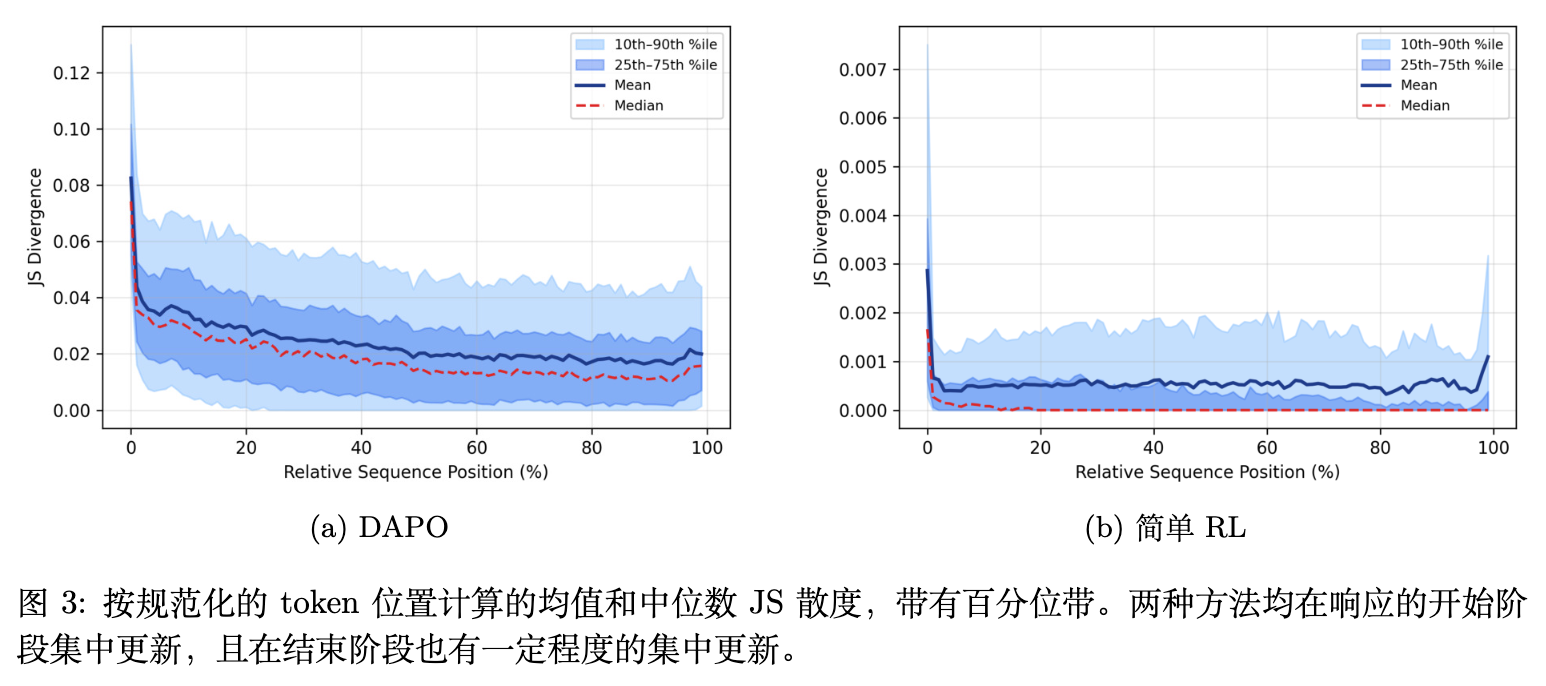

3.2 分布偏移的位置集中性

研究进一步分析了序列生成过程中散度变化的发生位置。将词元索引按序列总长度归一化后,可以观察到散度在序列特定位置的聚集现象。

无论是 DAPO 还是 SimpleRL,均呈现出明显的结构特征:整个序列的平均散度在响应的起始阶段最高,在序列中段下降,并在接近结尾处再次小幅上升。

起始阶段的散度集中,对应了模型在推理初期进行高层级分支决策(branching decisions)的修改;而结尾处的散度上升,则对应了对答案格式化和终止行为(termination behavior)的调整。然而,聚合趋势掩盖了单条序列内部的变异性;在单条序列内,高散度词元可能零星散布在各个阶段。

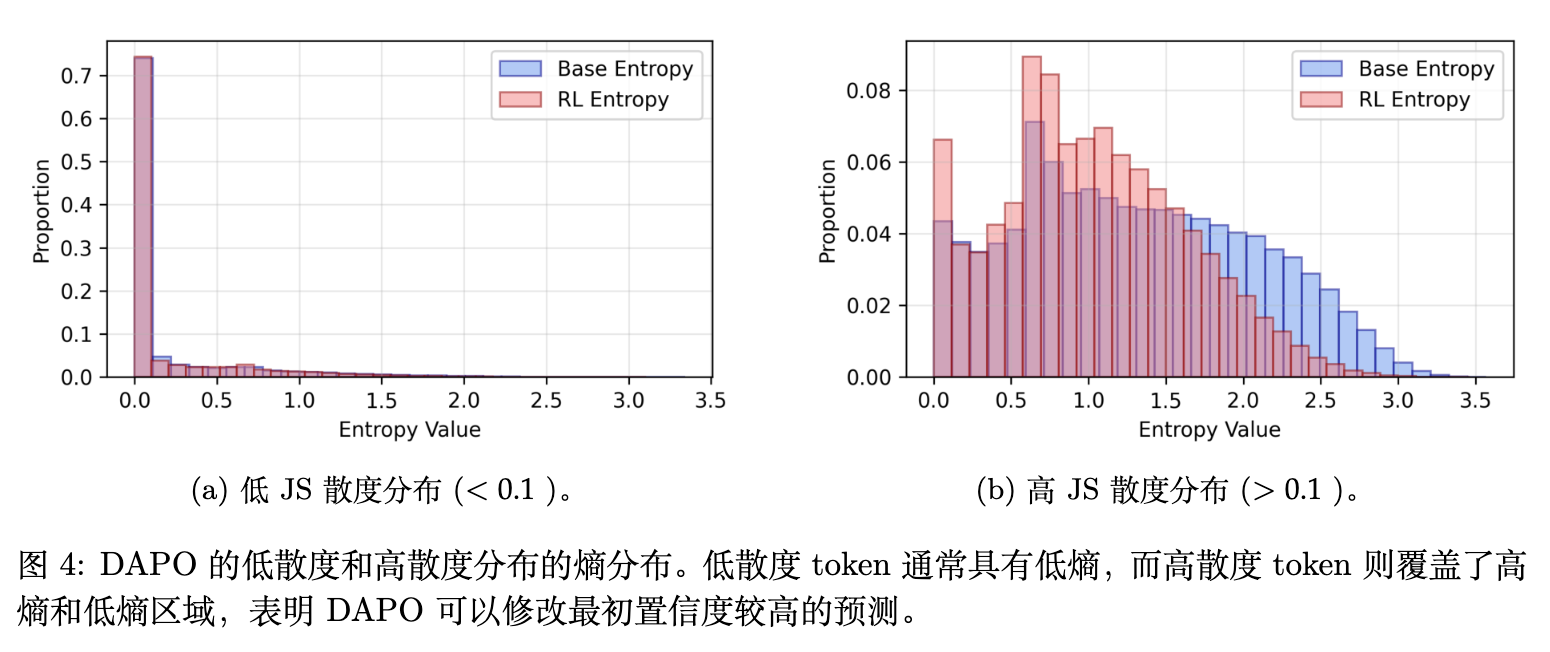

3.3 散度与预测熵的交互关系

高散度位置是否对应基础模型原本不确定的预测?为了探究这一点,研究计算了基础模型在各词元位置的预测熵:

将词元分为低散度和高散度两组后,分析表明:

低散度位置的词元分布绝大多数具有较低的熵,说明被保留的分布主要来源于基础模型已较为确信的预测。

相比之下,高散度位置覆盖了广泛的熵值区间。DAPO 算法能够同时修改初始高熵和低熵的预测,这体现了其覆盖甚至推翻基础模型自信预测的能力。SimpleRL 则倾向于在基础模型具有较高熵的区域集中产生散度,反映出一种更为保守的更新策略。

clip-higher 参数的作用在这里也较为明显:较高的 upper clip (0.28) 能够在基础模型低熵区域产生更多的分布变化,而收紧该参数 (0.2) 则会将高散度分布限制在基础模型高熵区域。

3.4 发生偏移的词元语义类型

在发散的分布中,模型具体是在修改哪些词元?通过绘制高散度和低散度分布下采样词元的词云:

高散度分布中采样的词元多包括常见的虚词、与推理过程相关的术语以及部分方程片段。低散度分布则被数字、运算符和数学表达式的结构成分主导。

但需要指出的是,仅凭词元的字面标识无法决定其散度行为。以“the”为例,它频繁出现在高散度词元中,但如果统计该词在所有被采样情况下的整体散度分布,会发现其依然集中在低散度区间。这说明散度变化是高度依赖上下文的,取决于词元在整个推理轨迹以及基础模型预测分布中的具体角色。

3.5 与监督微调(SFT)的对比

这种稀疏性是 RL 独有的,还是微调过程的普遍现象?通过将 RLVR 与监督微调(SFT)模型进行对比可以得出结论。

SFT 的目标是直接模仿目标词元,而非基于生成的轨迹优化可验证奖励。在相同的散度测量方法下,SFT 产生的高散度集合规模明显更大,散度分布也更为宽泛。同时,SFT 在整个响应序列的各个位置都引发了普遍的散度提升。这说明,RLVR 观察到的分布偏移稀疏性并非微调的通用结果,而是 RL 优化的特定属性。

4. 交叉采样:散布变化的决定性作用

既然只有极少部分词元的分布发生了明显偏移,这些分散的变化是否直接对 RLVR 带来的性能提升负责?为了定量评估这一问题,研究设计了交叉采样(Cross-Sampling)实验。

交叉采样在序列生成过程中,选择性地在基础策略 和 RL 策略 之间交换词元选择。

4.1 交叉采样算法框架

令 表示解码生成的词元序列,停止时间 。设主策略为 ,干预策略为 。

定义一个切换规则 ,基于当前生成前缀 ,决定下一步是从主策略采样()还是从干预策略采样()。由此得到混合策略:

具体而言,切换规则依据散度阈值 定义:

研究采用两种设置:

-

前向交叉采样(Forward Cross-Sampling):主策略为 ,干预策略为 。该实验测试在基础模型的轨迹中注入少量的 RL 词元,是否足以恢复 RL 级别的推理性能。 -

反向交叉采样(Reverse Cross-Sampling):主策略为 ,干预策略为 。该实验测试在 RL 模型的生成中,替换掉少量高散度位置的词元,是否会迅速导致性能崩溃。

此外,研究引入了干预预算(Intervention Budgets) ,即在达到 次干预后,后续强制使用主策略生成。

4.2 实验结果与发现

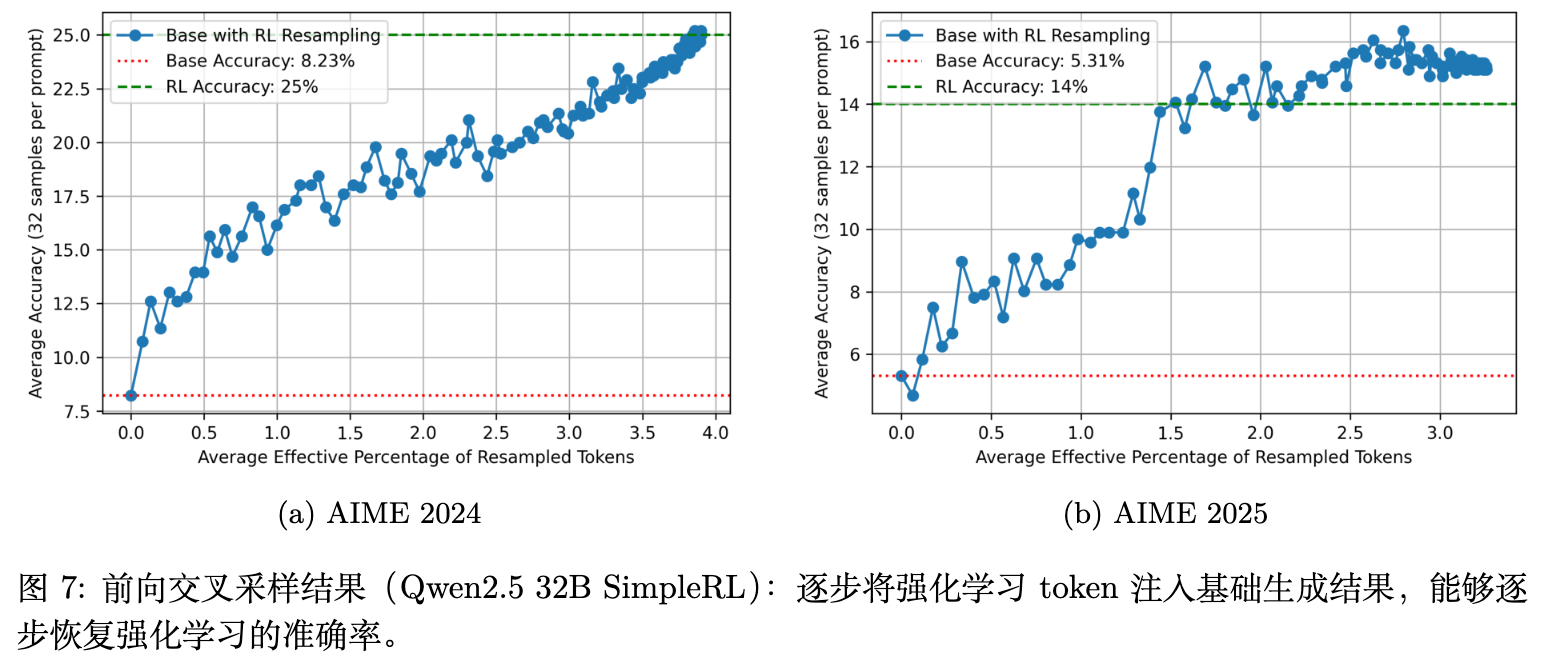

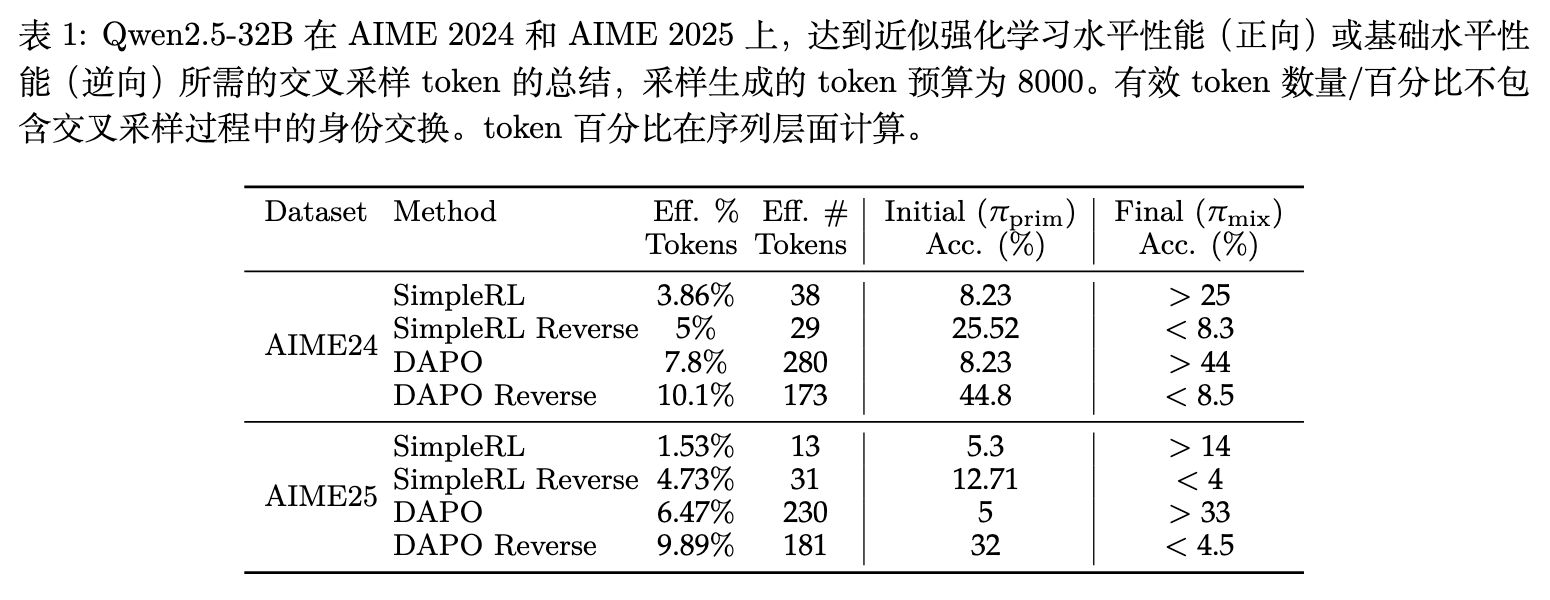

前向交叉采样结果:

数据表明,将少量 RL 采样的词元注入到基础模型生成中,即可恢复甚至略微超越单独 RL 策略的性能。对于使用 SimpleRL 的 Qwen2.5-32B 模型,在 AIME 2024 数据集上,平均每条序列注入不到 4% 的 RL 词元(相当于少于 40 个有效词元替换),就足以弥补基础模型(约 8%)与 RL 模型(约 25%)之间的性能差距。在 AIME 2025 上,仅需要 1.53% 的有效交叉采样就能实现同样的效果。对于性能更强的 DAPO 模型,需要注入的词元比例相对较高(约 7.8%),但相对于整个序列长度,决定性的词元决策数量依然很小。

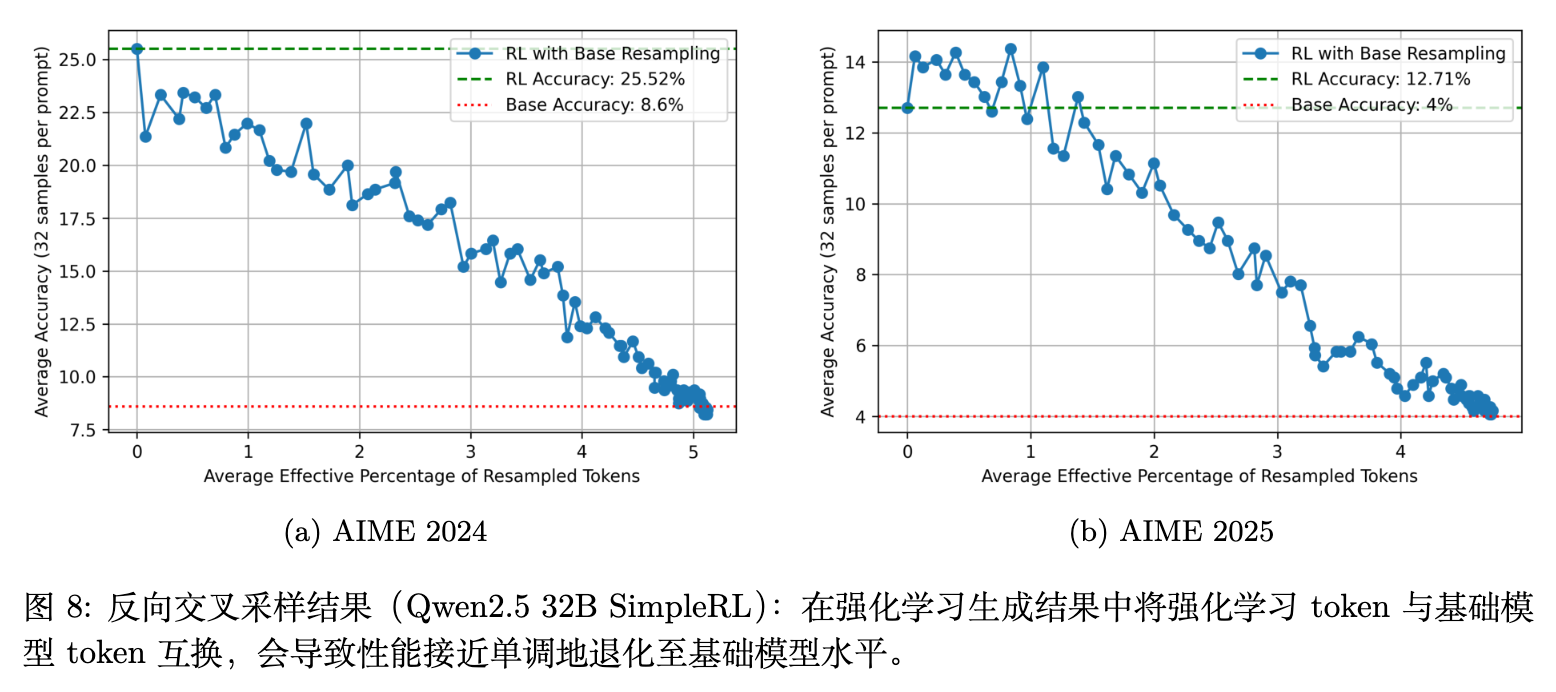

反向交叉采样结果:

反向实验同样证明了 RL 策略对其少数词元决策的高度敏感性。将混合策略设置为主策略为 RL 并在高散度位置使用基础模型干预时,少量基础词元的混入会导致准确率迅速崩塌。在 AIME 2024 上,替换约 5% 的高散度分布词元(单条序列不足 30 个词元),就能使 SimpleRL 模型的准确率从约 25% 跌回基础模型水平(约 8%)。

更进一步分析显示,被替换进来的基础词元通常在语义上是合理的,但在模型中却会引导出不同的下游条件分布,最终导致推理轨迹偏离。这揭示了模型推理轨迹对特定局部替换的高度敏感性。

渐进式的轨迹引导(Progressive Trajectory Steering):

随着干预预算的增加,模型性能呈现平滑且近似单调的变化。这说明 RLVR 带来的性能增益是分布在多个决策点上的,而并非依赖单一的决定性截断点。即使仅仅在序列早期执行了几次干预,也能在随后完全交由主策略解码时产生可测量的性能差异。RLVR 的作用是修改少量的局部词元选择,这些选择将生成过程引向基础模型本就有能力继续生成、但在原先分布下难以被触发的高效推理轨迹。

5. 细粒度分布转移机制分析

确立了高散度位置词元的决定性作用后,研究进一步下钻到具体的概率分布内部:在这些出现显著散度的位置,RLVR 是引入了全新的候选词元,还是仅仅在原有候选词元间重新分配了概率质量?

5.1 Top-k 重叠率与排序调整

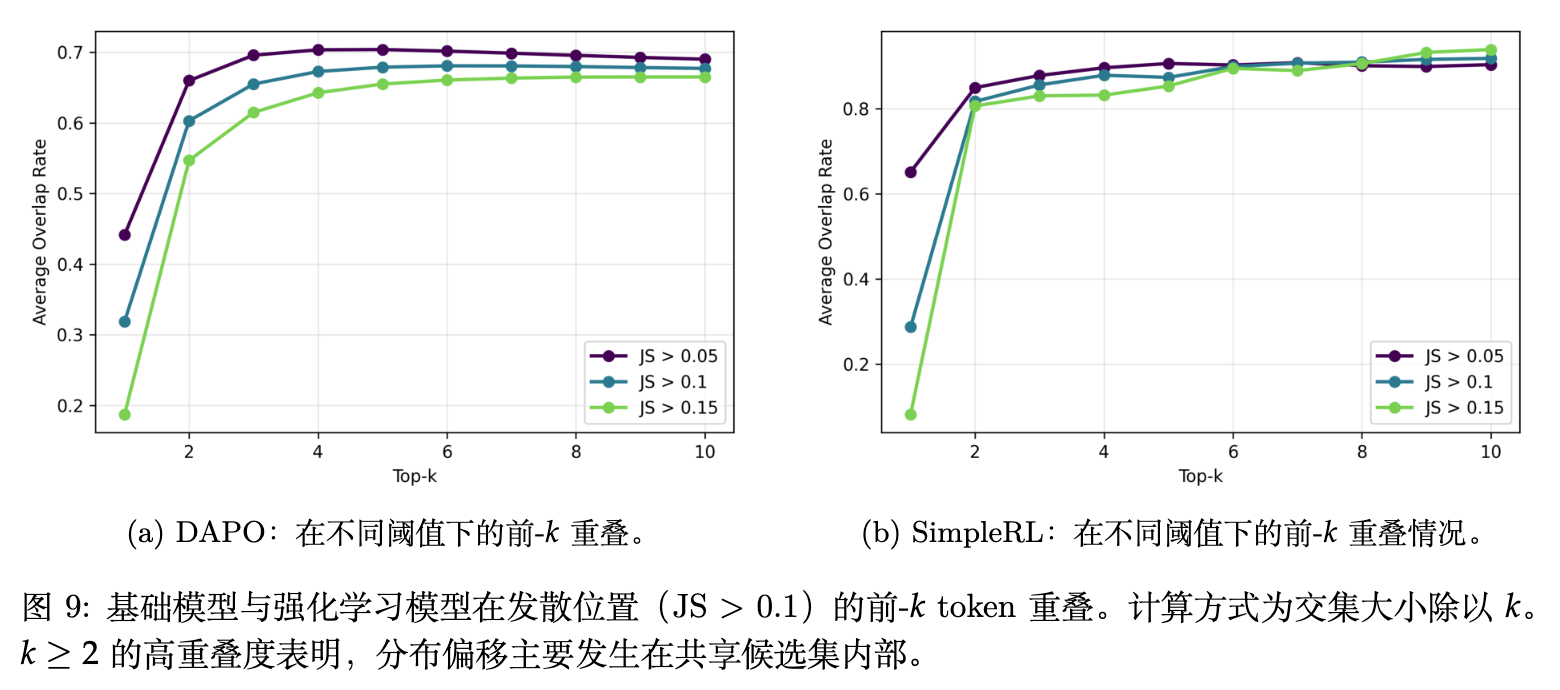

研究首先比较了基础模型与 RL 模型在给定位置的 top- 词元集合的重叠情况。

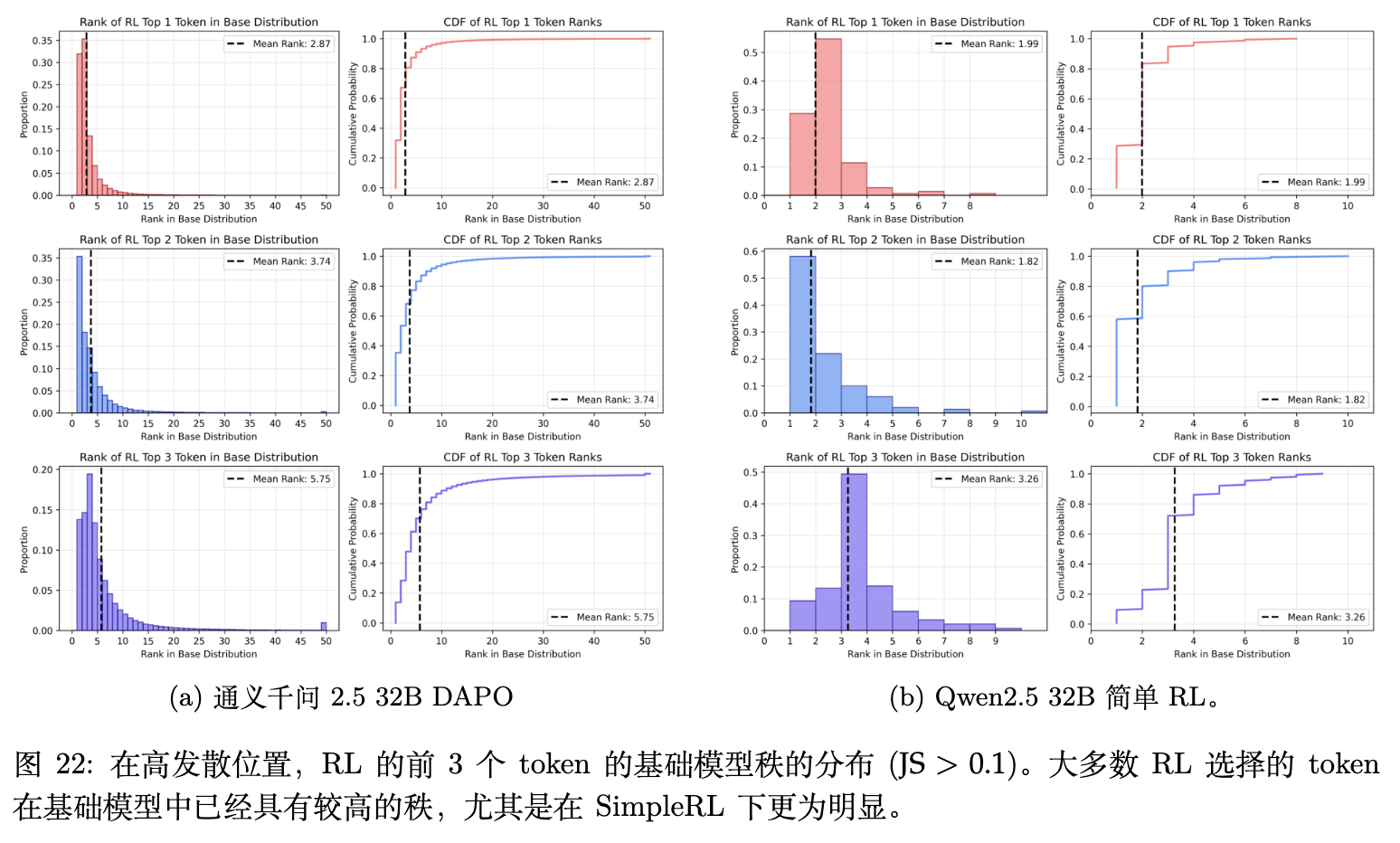

即使仅考察高散度(JS > 0.1)的词元分布,当 时,两个模型的 top- 集合重叠率依然保持在较高水平。SimpleRL 的平均重叠率超过 80%,DAPO 略低但同样存在大量重叠。这说明尽管 top-1 的词元在高散度位置经常发生改变,但替换上来的词元绝大部分原本就已经位于基础模型的 top-3 之中。

排名分布图更为直观地展示了这一点。在 DAPO 和 SimpleRL 中,大量 RL 的 top-1 词元本就是基础模型的 top-1,而超过 80% (DAPO) 和 90% (SimpleRL) 的 RL top-1 词元都在基础模型的 top-3 范围内。

对比 DAPO 的 upper clip 机制可以发现,0.28 的 clip-higher 会导致最高排名词元间更频繁的重新排序,而 0.2 的严格裁剪则将概率更多地集中在单一主导词元上。

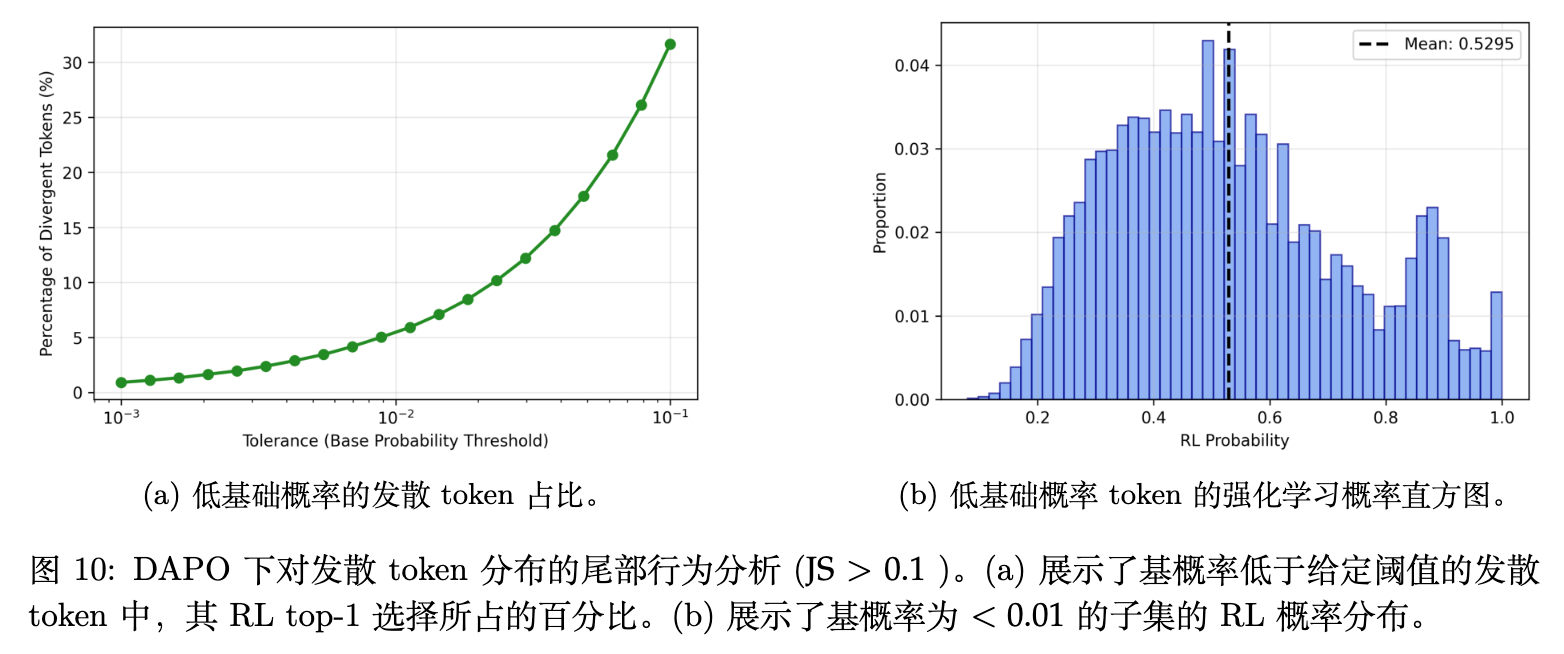

5.2 低概率词元行为:是创新还是筛选?

RLVR 是否倾向于提拔那些在基础模型下概率极低的词元?

研究统计了在高散度位置,RL 模型选取的 top-1 词元在基础模型中的原始概率。

在 DAPO 中,仅有大约 5% 的高散度 RL top-1 词元在基础模型中的概率低于 0.01;在 SimpleRL 中这一比例接近于零。这表明,RLVR 极少提拔在基础模型中极度不可能的词元。RLVR 主要通过放大那些本身合理但权重不足的替代选项来实现性能优化,而非发明全新的表达。

当然,具备 clip-higher 的 DAPO 确实比去除了该机制的变体提拔了更多的相对低概率词元,这佐证了 clip-higher 有助于更广泛的探索,尽管这种低概率提升现象在宏观上依然少见。

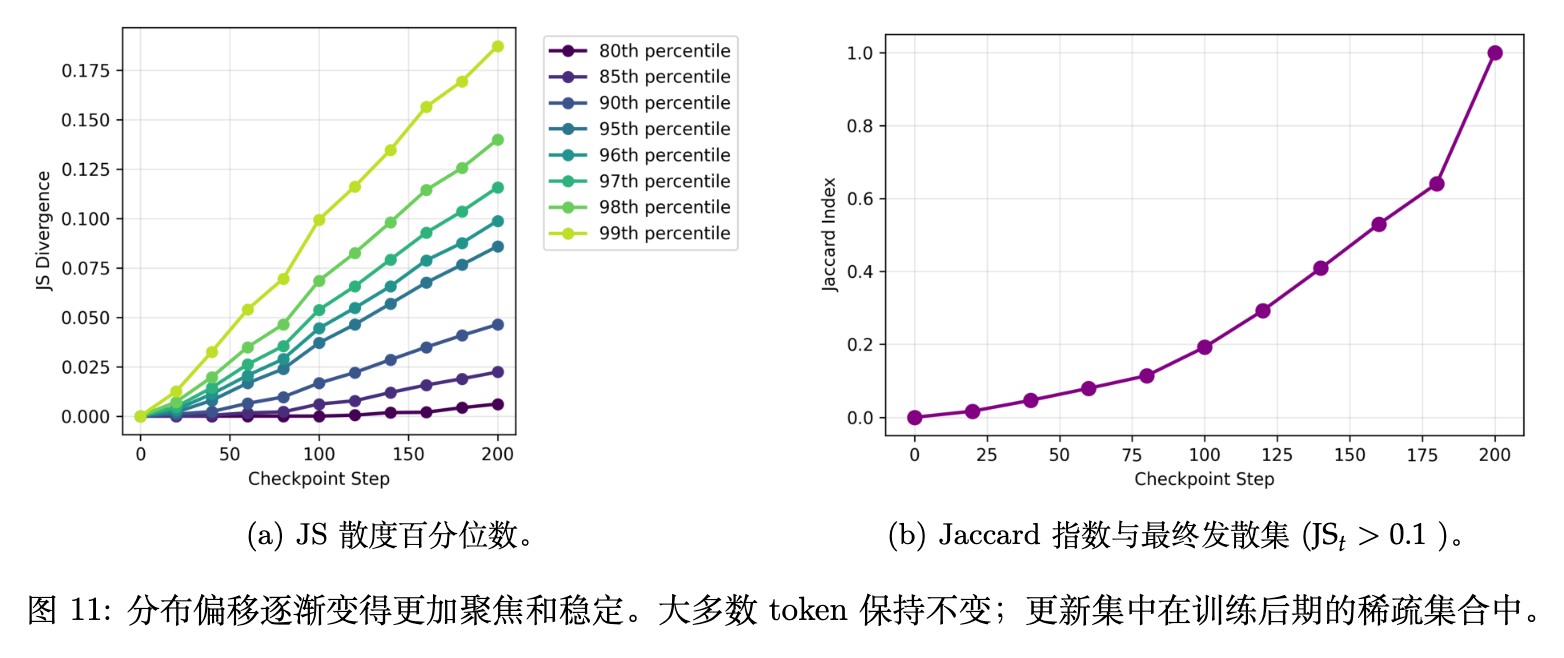

5.3 训练过程中的演进演化

利用训练过程中的中间检查点分析分布偏移的动态变化可以发现,JS 散度在整个训练过程中呈现单调上升趋势。值得注意的是,高百分位数(如 95th, 99th)的散度增长速度远快于低百分位数。这说明随着训练的进行,分布的变化愈发集中于少数词元位置,而绝大多数词元的分布保持稳定。Jaccard 重叠指数的计算也支持了这一观点:前期分歧集的重叠度稳步提升,在训练末期出现急剧增加。

6. 探索性研究:基于散度加权的优势函数

前文分析指出,RL 的优化实质上是高度集中且具有稀疏性的。如果性能的提升仅依赖于一小部分关键词元的改变,是否可以通过基于散度调整学习信号来更高效地引导训练?

为了初步探讨该设想,研究提出了基于散度加权优势函数(Divergence-Weighted Advantage)的探索性干预实验。

6.1 散度加权优势的定义

在标准的 GRPO 或 DAPO 框架中,PPO 风格的替代目标函数对序列内的每个词元使用均等的优势函数(仅在重要性采样比率上有所不同)。

研究提出将组归一化后的优势 通过一个词元级别的权重 进行重新缩放,得到加权优势 。为确保此权重仅影响幅度而不改变原有的梯度流,散度计算从计算图中剥离。

为了与现有训练框架(如 verl)兼容,研究使用新旧策略间的 KL 散度估计值作为散度的度量标准:

采用基于 Sigmoid 的加权方案以确保权重有界:

其中参数 控制加权的方向与幅度: 放大高散度词元的更新(high-KL boost),使得学习信号集中在已发生较大分布变化的区域; 则放大低散度词元的更新(low-KL boost),以探索当前尚未发生明显改变的区域。

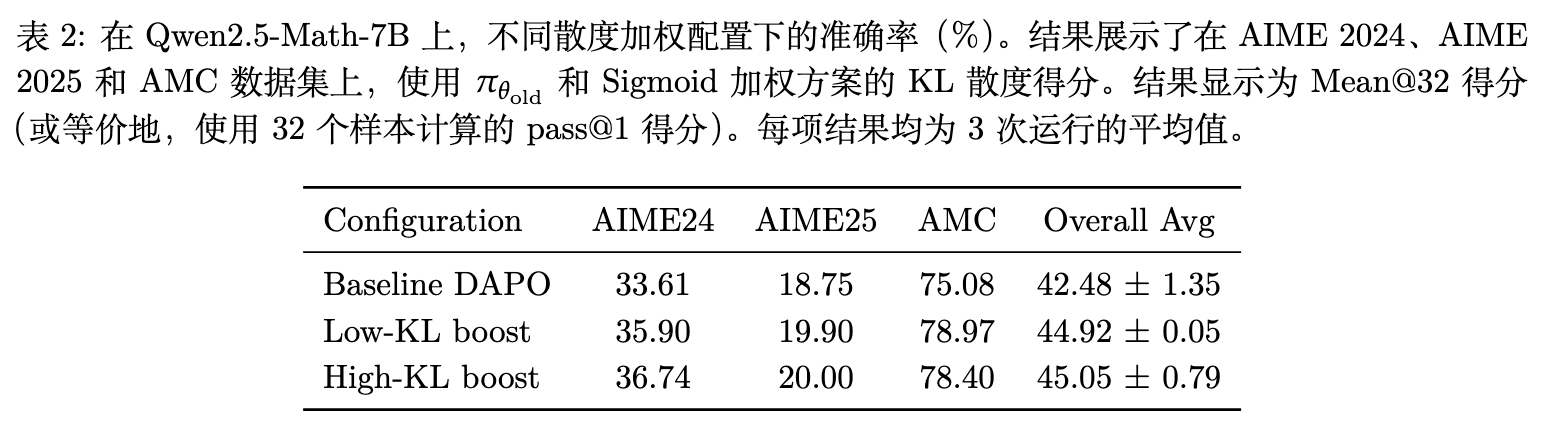

6.2 实验结果

在 Qwen2.5-Math-7B 上的训练结果显示,基于散度调整词元级更新能够带来性能增益。无论是 low-KL boost 还是 high-KL boost,都在 AIME 2024、AIME 2025 和 AMC 上取得了优于基线 DAPO 的平均准确率。这为“针对性词元驱动性能提升”的假设提供了经验层面的支持。然而,不同的加权方向都有效果,暗示寻找最佳的加权策略需要结合具体模型和自适应调度机制做进一步的探讨。

7. 附录解析

7.1 交叉采样的序列级散度界限推导 (Appendix A.1)

在评估交叉采样时,算法通过在词元层面控制分布散度(设定阈值 )来决定是否切换策略。研究者需要在理论上证明:对词元级别的散度设定阈值约束,能够有效地界定整个序列层面的分布散度。

引理 A.1 (KL 分解)

设 为 上的概率分布,可分解为 与 。令 和 表示 的边缘分布,则有:

证明逻辑主要是利用期望的线性性质和对数函数的性质,将序列层面的比值转化为单步词元的期望和。

命题 A.2 (词元级 KL 阈值推导序列级 KL 上界)

假设切换规则由 KL 阈值定义:

定义轨迹上未发生干预的步骤数为:

则混合分布 与干预分布 之间的序列级 KL 散度满足:

该命题通过将切换条件代入到引理 A.1 中,利用示性函数分离干预步与非干预步,从而得到了序列级别散度的一个严谨上界。

引理 A.5 (基于 Skew JS 的 JS 分解)

由于 JS 散度在交叉采样实验中具备更好的数值稳定性,研究给出了 JS 散度的分解定理。与 KL 散度不同,JS 散度的序列分解会引入一种历史依赖的 Skew JS 散度。

定义 ,以及权重系数 ,则有:

证明通过构造单步条件分布 ,利用 Radon-Nikodym 导数将 JS 散度展开并映射到偏斜(Skew)JS 形式上。这个严谨的推导为 JS 散度的序列级分析打下了坚实基础。

命题 A.6 (词元级 Skew JS 控制推导序列级 JS 上界)

在满足 Skew JS 的条件下,序列级 JS 散度同样被边界化:

或者等价表示为:

这些数学证明从理论层面保障了交叉采样策略的合理性:通过局部词元阈值筛选,能够对全局序列分布差异进行有效控制。

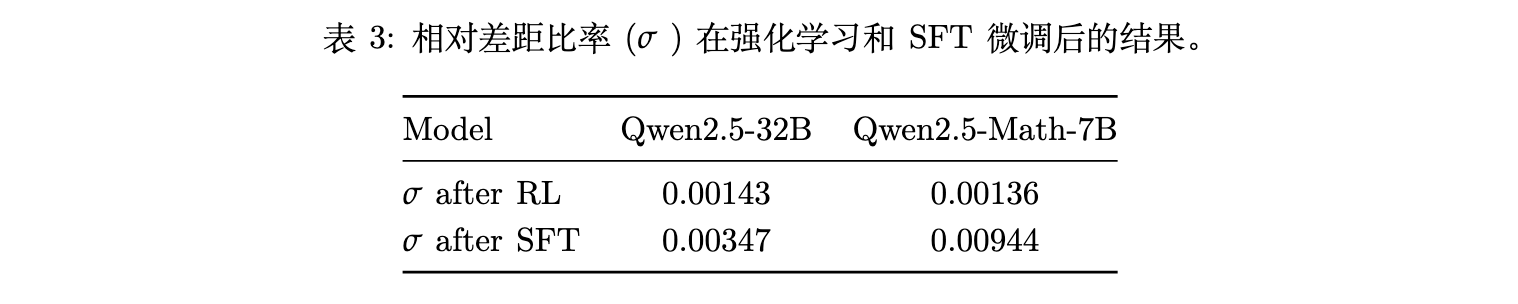

7.2 权重级别的变化分析 (Appendix A.3)

为了从另外一个正交的维度验证 RL 优化的局部性,研究团队在参数层级(Parameter level)计算了相对差距比(Relative gap ratio, ),以量化微调前后权重的差异。

统计表明,Qwen2.5-32B 在经过 RL 微调后, 值为 0.00143,而经过 SFT 微调后为 0.00347。在 Qwen2.5-Math-7B 上,差距更为明显。参数级别的数据进一步支持了先前的分布层面发现:相比于 SFT 引发的更广泛的更新,RL 获得性能增益所依赖的是一种稀疏且有针对性的参数调整。

7.3 扩展数据集与模型上的结果一致性 (Appendix A.4 - A.6)

研究还附带了大量对比实验来验证结论的鲁棒性:

-

截断影响消除:对比 top-、top-、top- 甚至 top-(完整分布),证明了高度稀疏的模式在不同采样参数和非截断评估下依然成立。 -

多模型验证:在 Mistral-Small-24B 和 Qwen3-8B-Base 模型上进行的实验,均得出了与主实验一致的结论:词元级分布变化集中分布在响应的开始与结束阶段,并且重叠度(Top-k overlap)维持在高位。 -

交叉采样的随机基线对比:在 AIME 2024 上将针对高散度词元的交叉采样与“随机位置词元替换”进行对比。结果显示,随机替换带来的性能恢复十分缓慢,这反证了高散度词元对推理轨迹确实起着决定性的关键引导作用。

8. 总结与研究启发

该论文详细剖析了强化学习机制在大语言模型内部运作的微观机理。总结而言,论文表明:RLVR 对 LLM 的改造并非是在所有词元上的均匀扩散,而是一种稀疏、特定且结构化的局部调整。

绝大多数情况下,RL 模型与基础模型的思考方式无异。RLVR 的精髓在于识别出序列中的一小部分关键决策节点(通常覆盖较宽的熵范围),在这些节点上,通过对基础模型原有候选词元进行重排序(而非引入全新结构),引导模型走向能获得更高奖励的推理轨迹。

该研究提供了几个维度的重要启发:

-

评估范式的下沉:理解 RL 优化不能仅仅停留于 Reward 曲线或评估集分数,分析词元级别的分布偏移能够帮助定位模型能力提升的确切来源。 -

优化效率的改进空间:既然只有小部分词元决策左右了结果,未来可以设计出针对性更强的强化学习目标函数(如文中初步探索的散度加权优势函数),以提升 RL 的采样与训练效率,减少无意义位置的参数更新带来的潜在对齐税(Alignment Tax)或灾难性遗忘。 -

推断时的干预策略:交叉采样实验的成功暗示了推断时通过部署轻量级的外部分类器(指导何时调用特定策略)进行动态投机采样或混合路由(Routing)的可能性,以平衡计算成本与推理性能。

更多细节请阅读原文。

往期文章: