让每一项优秀工作,被更多人看见:点击进入投稿通道

-

论文标题:How Far Can Unsupervised RLVR Scale LLM Training? -

论文链接:https://arxiv.org/pdf/2603.08660

TL;DR

今天解读一篇来自清华 & 上海 AI Lab 的一篇论文《How Far Can Unsupervised RLVR Scale LLM Training?》该研究针对无监督带验证奖励的强化学习(Unsupervised Reinforcement Learning with Verifiable Rewards, URLVR)在大型语言模型(LLM)训练中的扩展能力进行了全面分析。

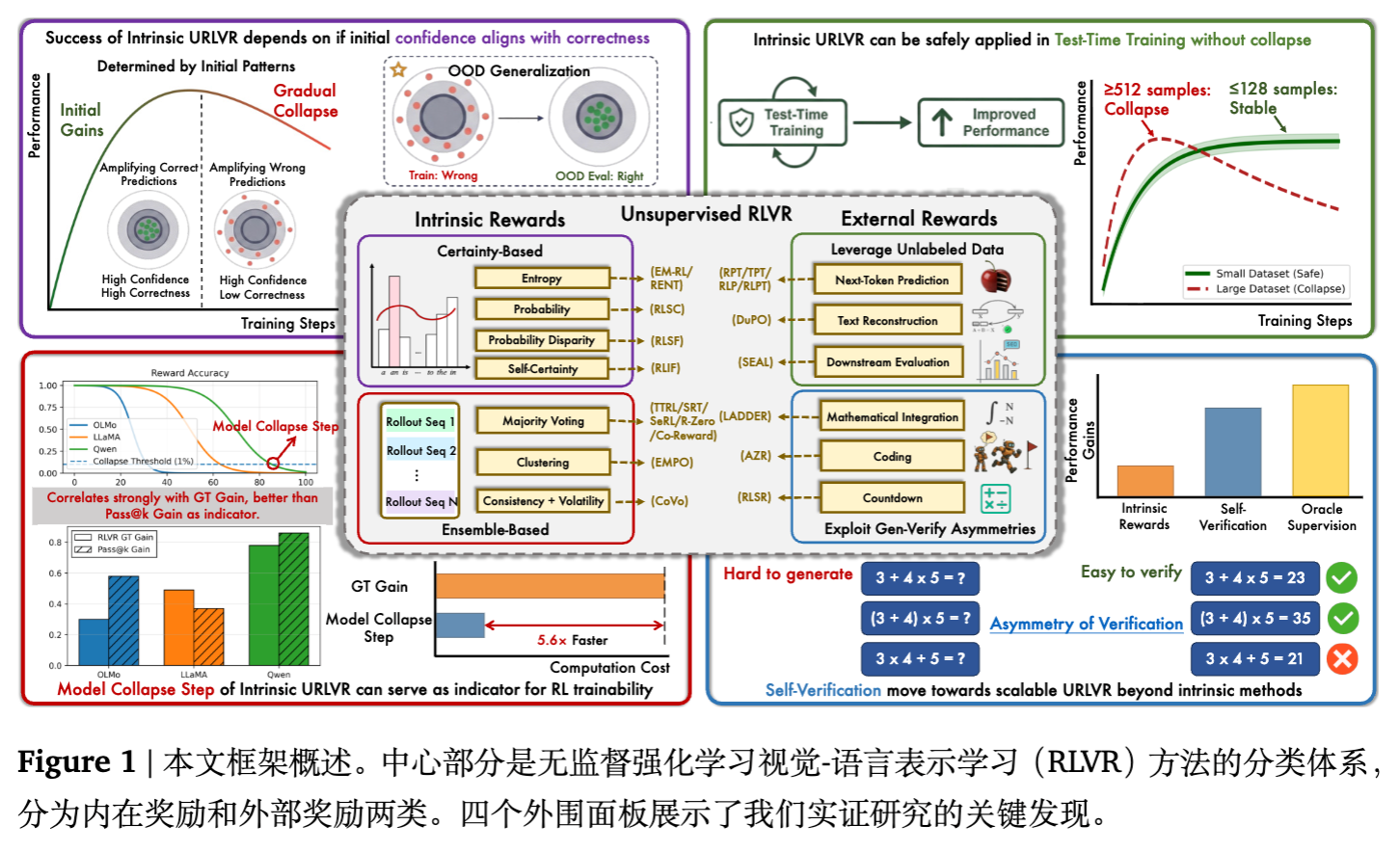

研究将 URLVR 方法分为内在奖励(Intrinsic Rewards)和外部奖励(External Rewards)。理论分析表明,所有内在奖励方法均通过操纵交叉熵收敛于对模型初始分布的“锐化(Sharpening)”,即放大模型原有的偏好。实证实验证实,内在奖励训练普遍呈现“先上升后下降(Rise-then-fall)”的模式,最终必然导致模型崩溃(Model Collapse),崩溃的时间取决于模型的先验分布而非超参数工程。尽管存在扩展瓶颈,内在奖励在小数据集和测试时训练(Test-Time Training, TTT)中依然有效。基于此动态特性,本文提出了“模型崩溃步数(Model Collapse Step)”作为评估模型强化学习可训练性的指标。最后,研究探讨了基于生成-验证不对称性的外部奖励方法,指出其可能突破内在奖励面临的置信度-正确性天花板,为实现可扩展的 URLVR 提供了路径。

1. 研究背景与动机

带有可验证奖励的强化学习(RLVR)在提升大语言模型推理能力方面取得了显著进展。在 RLVR 范式下,模型通过可与真实标签(Ground Truth)进行验证的奖励(例如数学题的正确答案或代码的成功执行)进行学习。近期的主流模型通过扩展监督式 RLVR 在数学、代码和科学基准测试上获得了提升。然而,向更高智能水平发展的过程中,这种依赖人工标注数据的监督方法面临瓶颈:随着模型能力达到或超越特定领域的专家水平,获取可靠的真实监督信号的成本高昂且逐渐变得不切实际。

这种监督瓶颈促使研究者转向无监督 RLVR(URLVR)领域。URLVR 旨在不依赖人工提供真实标签的情况下提取奖励信号。类似于预训练阶段利用海量无标签数据实现的缩放定律(Scaling Laws),URLVR 被期望能够将这种自我进化的范式扩展至后训练(Post-training)阶段。

当前的 URLVR 方法主要依赖模型自身的内在信号作为奖励,例如多路径采样的多数投票(Majority Voting)或基于熵(Entropy)的指标。尽管这些方法在训练初期表现出收益,但随之而来的是奖励作弊(Reward Hacking)和模型崩溃(Model Collapse)等失败模式。此外,不同方法在不同模型家族和评估设置下的表现存在差异,缺乏系统性的比较。因此,本文提出一个核心问题:内在奖励能否真正实现 LLM 训练的规模化扩展?

2. 无监督 RLVR 的分类学

URLVR 的问题设定为:在获取真实标签困难的可验证任务中,模型必须从不依赖人工努力的代理奖励信号中进行强化学习。根据奖励的来源,本文将 URLVR 方法分为两类:内在奖励方法和外部奖励方法,如图 1 所示。

2.1 内在奖励方法

内在奖励方法完全利用模型自身生成的内在信号作为代理奖励,无需真实标签。根据奖励的构建方式,内在奖励范式可细分为两类:

-

基于确定性的奖励(Certainty-Based Rewards):从策略在生成轨迹上的置信度(如逻辑值 Logits)推导奖励,鼓励低熵、高置信度的预测。 -

基于集成的奖励(Ensemble-Based Rewards):从多次采样的输出一致性中推导奖励(如多数投票),假设跨样本的一致性与正确性正相关。

符号定义:设 为输入提示, 为生成的输出序列,包含推理轨迹 和最终答案 (从 \boxed{} 中提取)。模型为参数化的 LLM 策略 ,其中 表示在给定上下文时下一个词的概率分布。

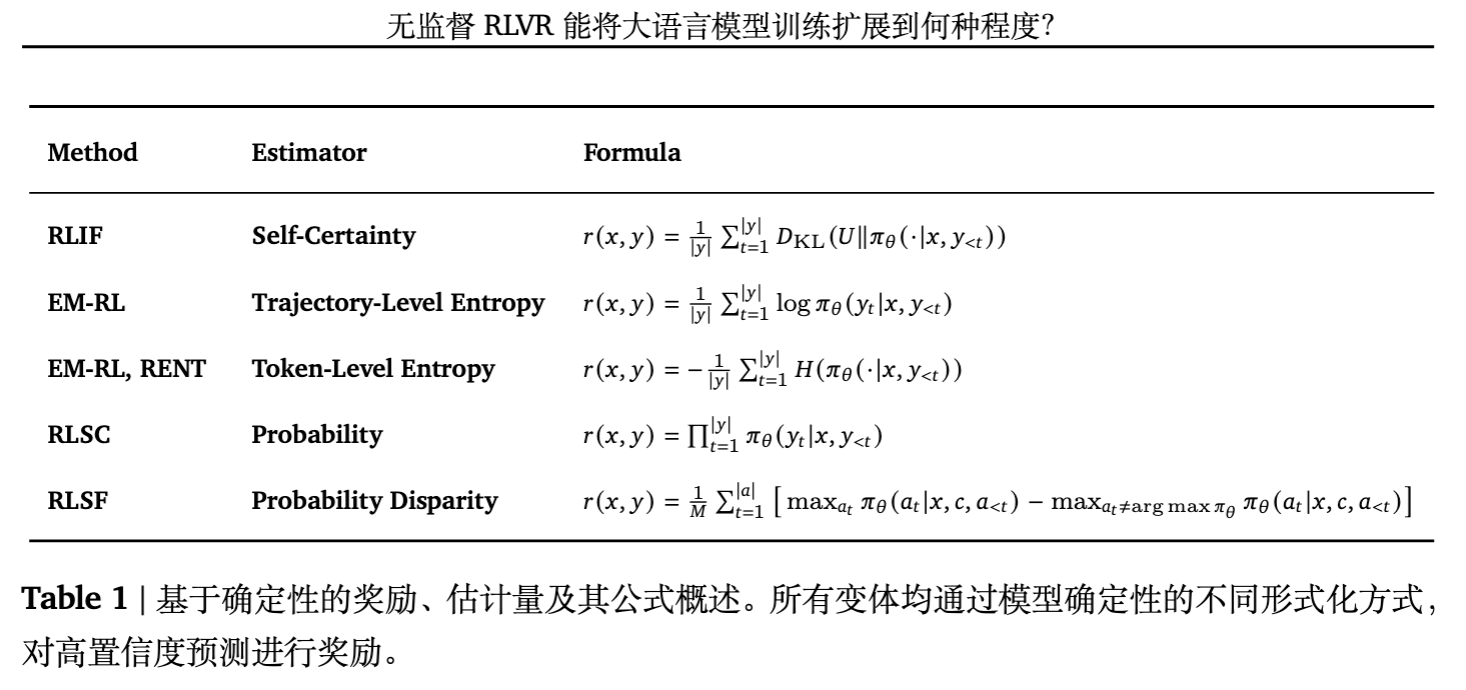

基于确定性的奖励

这类方法衡量模型对其输出的置信度,假设较高的置信度与正确性相关。这种置信度源自模型的内部状态(输出概率分布)。表 1 总结了几种形式化置信度的估计器:

-

RLIF (Self-Certainty) :计算词汇表上的均匀分布 与模型下一个词分布之间的平均 KL 散度,奖励低熵分布。公式为 。 -

EM-RL / RENT (Token-Level Entropy) :使用负的词级别熵作为逐步奖励信号,惩罚不确定性。公式为 。 -

EM-RL (Trajectory-Level Entropy) :聚合整个序列的置信度,即序列的对数概率。公式为 。 -

RLSC (Probability) :Trajectory-Level Entropy 的指数形式,直接使用原始概率。公式为 。 -

RLSF (Probability Disparity) :通过测量前两个概率最高词汇之间的差距,捕获最大值之外的分布锐度。公式为 。

在数学本质上,所有基于确定性的奖励都是对强化高置信度预测的不同形式化表达。最小化熵在功能上类似于最大化与均匀分布的 KL 散度。

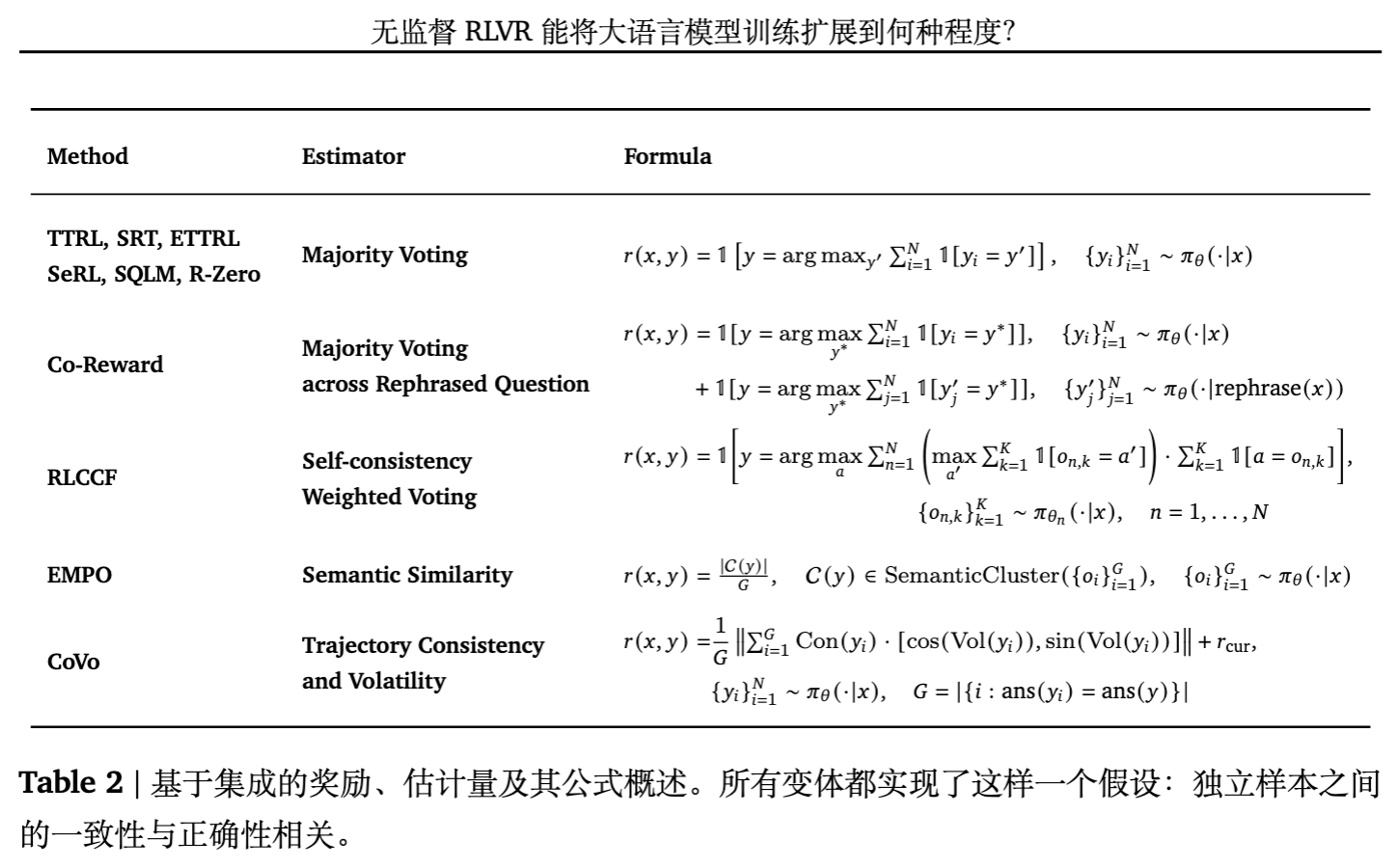

基于集成的奖励

这类方法利用多样化候选解的集合,而不是依赖单一输出的确定性。核心假设是模型生成答案之间的一致性与其正确性呈正相关。表 2 总结了相关方法:

-

TTRL / SRT / ETTRL / SeRL 等 (Majority Voting) :对多个采样结果的最终答案进行多数投票,生成伪标签(Pseudo-label)提供奖励信号。公式为 。 -

Co-Reward:通过问题重述(Paraphrasing)增强鲁棒性,计算重述前后的多数投票一致性。 -

RLCCF:基于自一致性加权投票。 -

EMPO:利用语义聚类进行软多数投票。公式为 。 -

CoVo:从中间推理轨迹的一致性和波动性中推导奖励。

基于集成的方法依赖抽样和共识,这引入了计算开销,并受限于特定任务是否具备合适的答案提取器和比较规则(如数学任务易于提取,而一般任务较难)。

2.2 外部奖励方法(External Reward Methods)

外部奖励方法通过外部机制而非模型内部状态生成可验证奖励。主要包含两种利用数据结构和计算不对称性的范式。

-

利用无标签数据生成奖励:大规模无标签语料库可以将语言建模转化为基于奖励的任务。例如,RPT 在无标签文本上奖励正确的下一个词预测;DuPO 采用对偶重构目标,模型需从自身输出中恢复原始无标签输入。这些方法的奖励规模随数据量增长,不受限于模型的内部状态。 -

利用生成-验证的不对称性(Generation-Verification Asymmetries):在诸多推理任务中,生成正确解需要庞大的搜索空间,但验证该解的过程是确定且计算成本固定的(如执行代码、查询定理证明器等)。例如,Absolute Zero 利用代码执行自动创建正确参考解并提供测试奖励;DeepSeekMath-V2 和 AlphaProof 利用定理证明器(如 Lean)的结果作为 RL 奖励。外部验证器独立于模型内部状态,其验证的可靠性不会随模型能力的提升而下降。

3. 内在奖励的理论机制分析:锐化(Sharpening)

本节对内在 URLVR 的底层机制进行理论分析。理论证明,尽管设计选择多样,优化内在奖励均会使模型向“锐化”其初始分布的方向收敛。这种机制的效果取决于模型的先验(Prior):当初始置信度与正确性对齐时,锐化会放大正确预测;若不对齐,则系统性地强化错误。

3.1 单步更新动力学

以 TTRL 及其多数投票奖励为代表方法,考虑标准的 KL 正则化 RL 目标:

其中 为参考策略, 控制正则化强度。该目标的闭式最优策略为:

在第 次迭代中,多数投票奖励定义为:

其中 是从当前策略 采样的 个输出集合, 为出现频率最高的答案。如果保持 不变并进行无限次更新,模型将收敛至最优策略:

由于 为二值,指数项对多数投票答案取 ,对其他答案取 。其显式形式为:

归一化配分函数为:

其中 为当前策略在多数答案轨迹上的总概率质量。公式 (5) 揭示了更新机制:在最优策略下,产生多数答案的每条轨迹其概率均被放大 倍。实际训练中,执行的是单次梯度更新,满足关系:

这表明具有正奖励的多数轨迹概率质量单调递增。

3.2 收敛至初始分布的锐化(Theorem 1 解析)

单步更新产生了“富者愈富(Rich-get-richer)”的动态效果。多次迭代此过程,策略呈几何级数收敛于集中在初始多数答案上的确定性策略。

定理 1:向确定性策略的几何收敛(Theorem 1. Geometric Convergence to Deterministic Policy)。

考虑训练过程:在每次迭代 中,采样 个轨迹,计算多数答案 ,使用奖励进行单步更新。假设满足以下条件:

(A1) 多数答案稳定性:存在足够大的 ,使得对所有 , 保持不变;

(A2) 有效学习假设: 对所有 成立。

则 以速率 几何收敛至 1,策略收敛为:

定理 1 的详细证明推导:

令单步更新效率为 :

代入 的解析表达式,并定义距不动点 1 的误差 :

其中 。因为误差项系数严格小于 1,序列 严格递减且下界为 0。根据有效学习假设 ,误差必定收敛于 0,即 。在 较小的情况下,收敛速率受 和 控制,形成几何收敛。

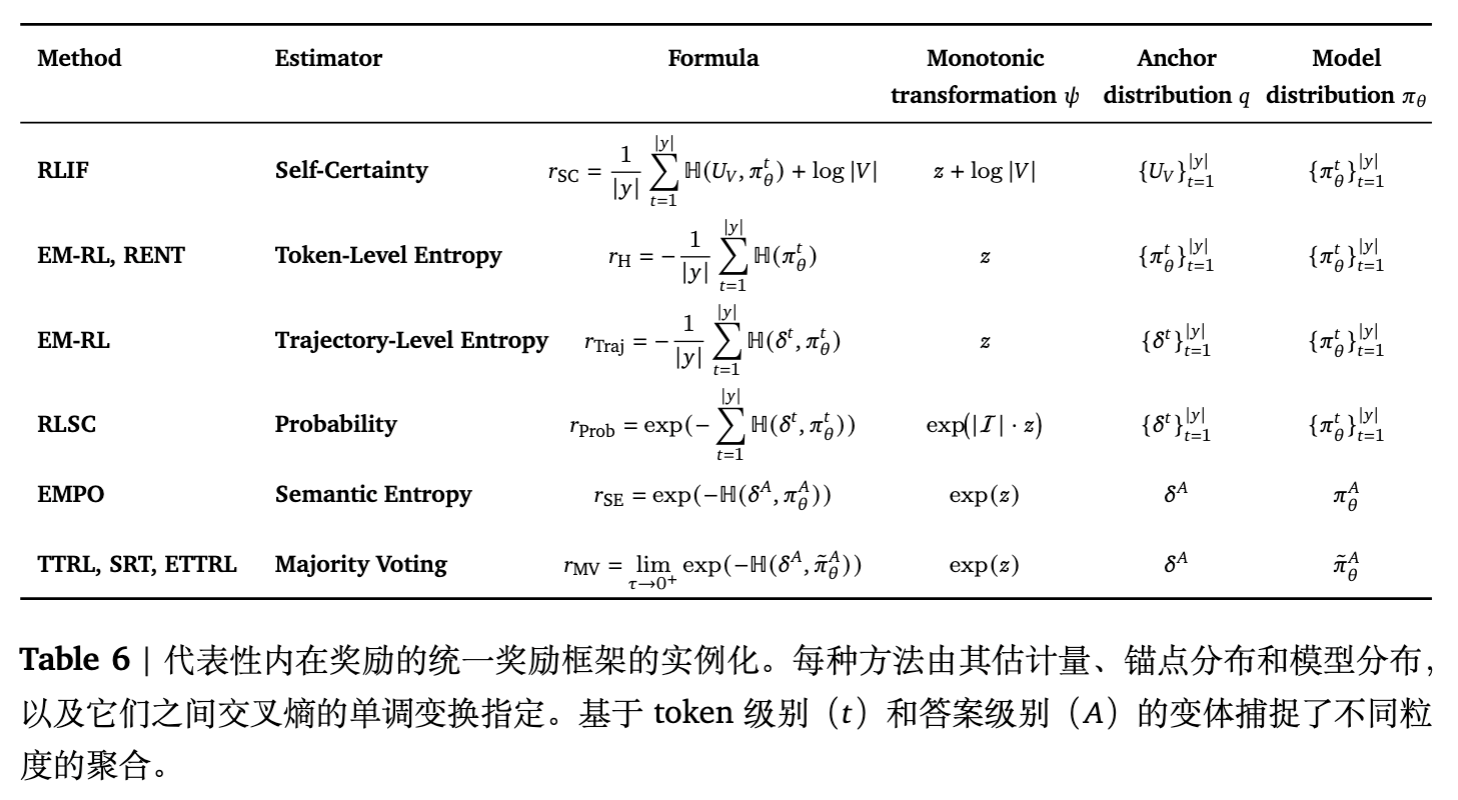

3.3 统一奖励框架(Unified Reward Framework)

为了说明上述不仅适用于多数投票,本文构建了一个涵盖多数内在奖励的统一框架。不同内在奖励的本质均在于操纵选定分布之间的交叉熵。

其中, 为聚合粒度(Token 级别或答案级别); 为模型分布; 为锚点分布(Anchor Distribution); 为交叉熵; 为符号因子; 为单调变换。表 6 展示了具体映射。

-

当 为均匀分布且 时(如 Self-Certainty),奖励偏离均匀分布的行为,即鼓励概率尖峰。 -

当 为尖峰分布且 时(如多数投票、Entropy、Probability),奖励模型向尖峰对齐。

通过广义锐化分析(Proposition 1)可知,所有满足 的方法均满足“奖励-置信度单调性(Reward-Confidence Monotonicity)”。即当主要轨迹的概率提升时,其获得的奖励也随之提升,形成自我强化的正反馈循环,最终驱动策略向确定性输出收敛。

4. 实验探究:内在 URLVR 何时起效?

基于锐化机制的结论,本节通过实证探讨内在奖励的生命周期以及问题级别的微观分析。

4.1 内在 URLVR 的“先升后降”模式

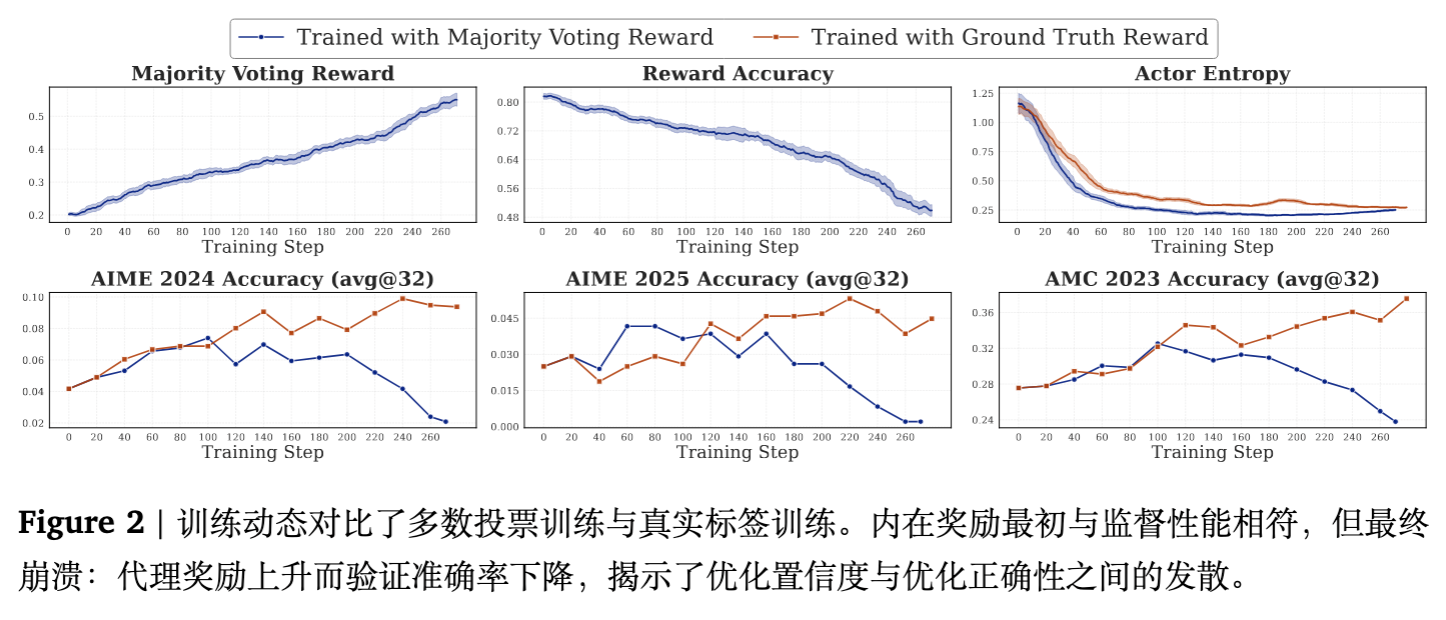

4.1.1 早期成功,随后崩溃

实验设置:在 DAPO-17k 数据集上使用 Qwen3-1.7B-Base 进行多数投票奖励训练,并在 AIME 2024、AIME 2025 和 AMC 2023 上评估。监控指标包括多数投票奖励(代理奖励)、奖励准确率(Reward Accuracy,即代理奖励与真实奖励的一致性)以及模型熵(Actor Entropy)。

实验结果:如图 2 所示,内在奖励在训练初期能够匹配甚至超越使用真实标签的训练性能。但随着训练步数增加,代理奖励持续上升,而奖励准确率和验证集性能却出现下降。这展示了明显的奖励作弊(Reward Hacking)现象,即优化置信度与优化正确性之间发生分歧。模型熵的快速下降进一步证实了性能提升与不确定性降低的关联。

本文对学习率、温度、批次大小和 KL 正则化等超参数进行了详尽调优(见附录 B.3),发现所有设定最终均不可避免地导致性能衰退,超参数只能改变崩溃发生的时间点,而无法避免崩溃的发生。这表明“先升后降”是机制上的内在限制,而非工程实现问题。

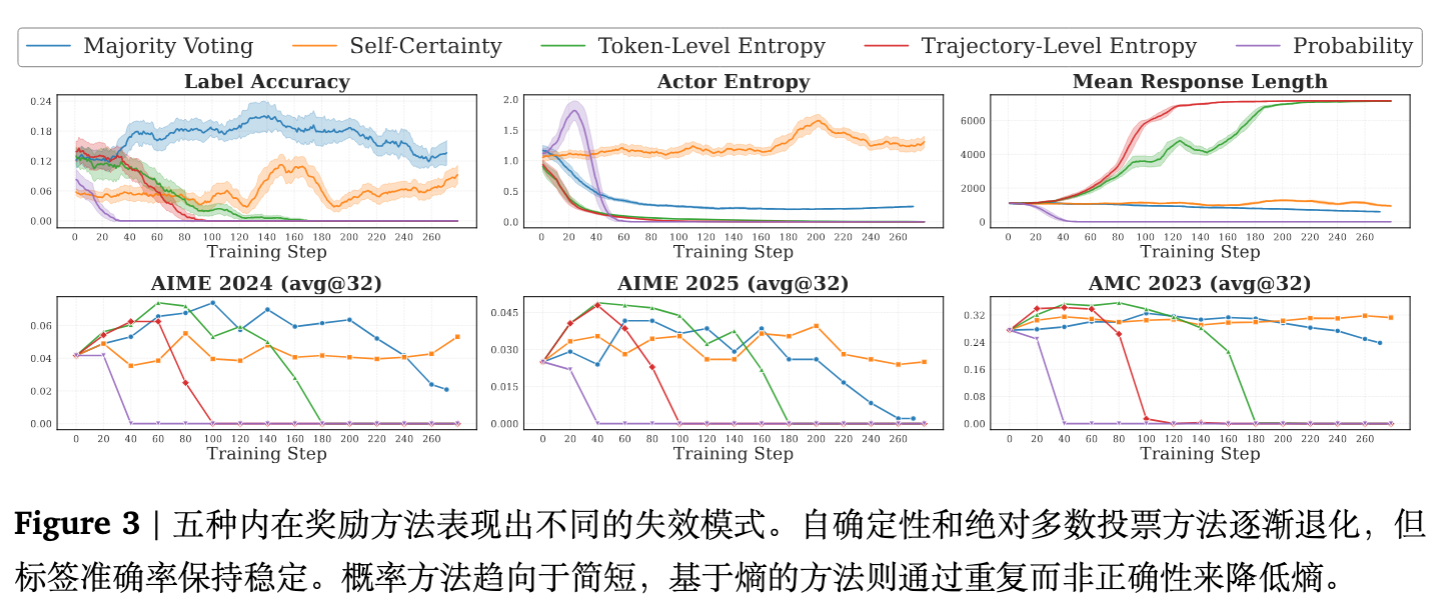

4.1.2 不同方法,不同失败模式

对比五种不同的内在奖励方法,图 3 揭示了各自独特的崩溃表现:

-

逐步退化(Gradual Degradation):Self-Certainty 和多数投票退化最慢,能在较长时间内维持较高的标签准确率。由于多数投票在答案层级计算,避免了 Token 级别的伪影(Artifacts)。 -

长度崩溃(Length Collapse):Probability 奖励通过连乘概率来计算,天然倾向于短序列。模型在降低熵的同时,生成过短的回复(如 Mean Response Length 缩短),形成专注于长度而非内容的奖励作弊。 -

重复崩溃(Repetition Collapse):基于熵的方法(Token-Level / Trajectory-Level Entropy)通过对序列熵取平均来优化。除了提高预测置信度外,模型倾向于通过重复输出高概率 Token 来最小化平均熵,导致生成带有重复文本的无意义长序列。

4.2 细粒度单题分析

为了验证早期收益是源于真正的错误修正还是偏好的放大,本文对单道数学题进行了追踪。

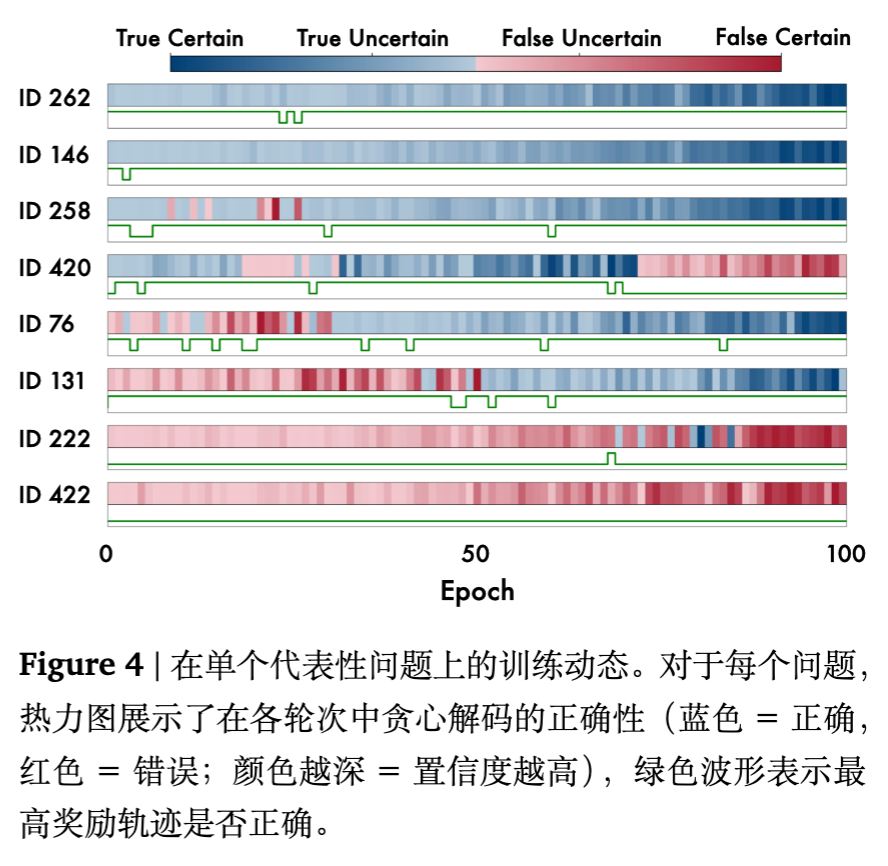

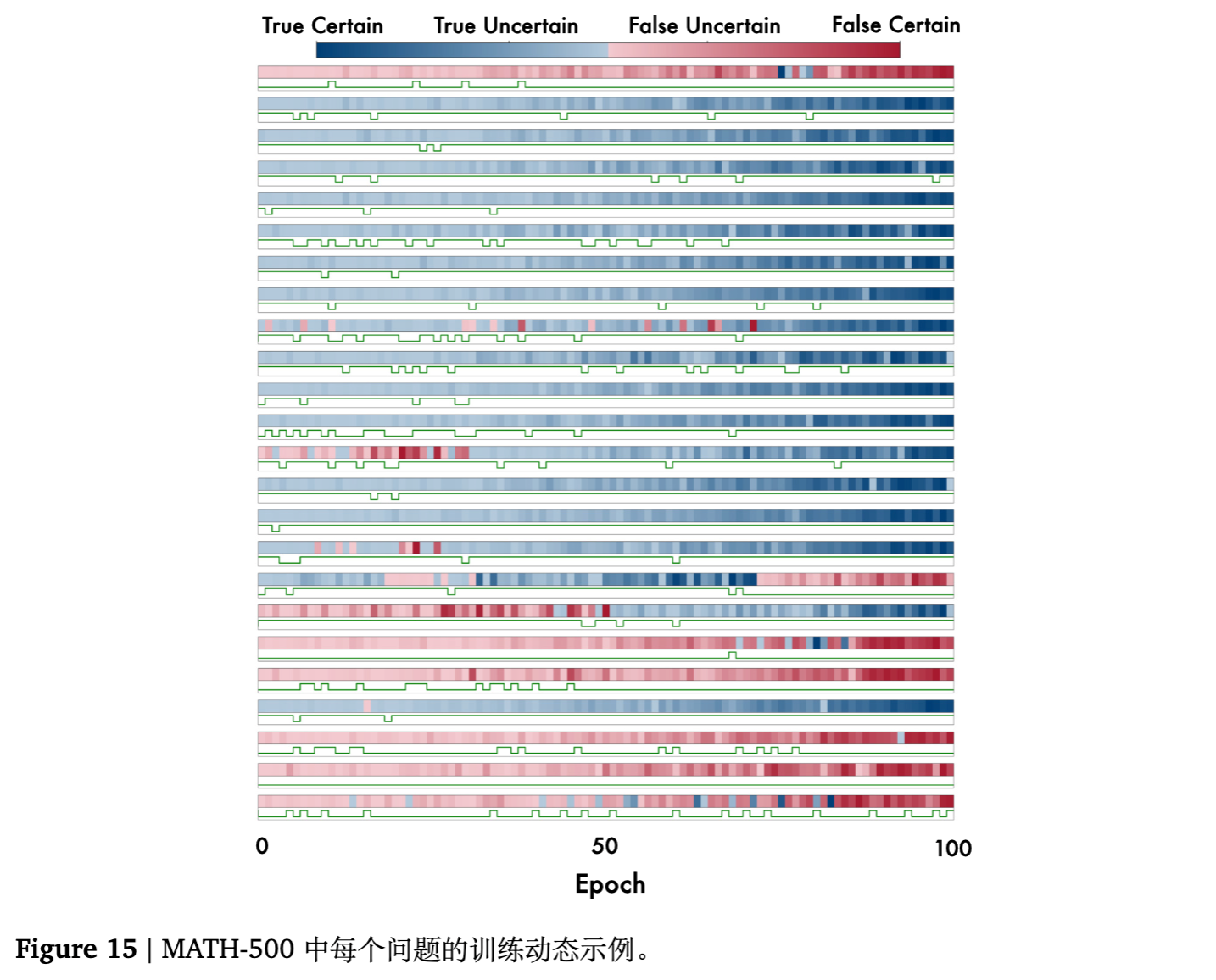

4.2.1 分布内的逐题锐化

实验设置:在 MATH500 中随机选取 25 题,每题独立训练 100 个 Epoch,使用 Trajectory-Level Entropy。

实验结果:如图 4 和图 15 所示,训练表现出四种模式:

-

放大成功(Amplifying success):模型初始贪心解码正确,训练仅加深其置信度。 -

放大失败(Amplifying failure):最高奖励样本始终错误,训练加深了对错误答案的置信度。 -

由错转对(Wrong Correct):由于最高奖励样本中多数为正确,引导模型翻转答案。 -

由对转错(Correct Wrong):最高奖励样本在对错间波动,导致模型逐步退化至错误。

在 25 道题中,仅有 3 题(12%)发生了正确性翻转。其余 22 题无论对错,仅是单纯地放大了初始偏好。这说明单题内部的训练过程本质上是“放大(Amplification)”而非“修正(Correction)”。

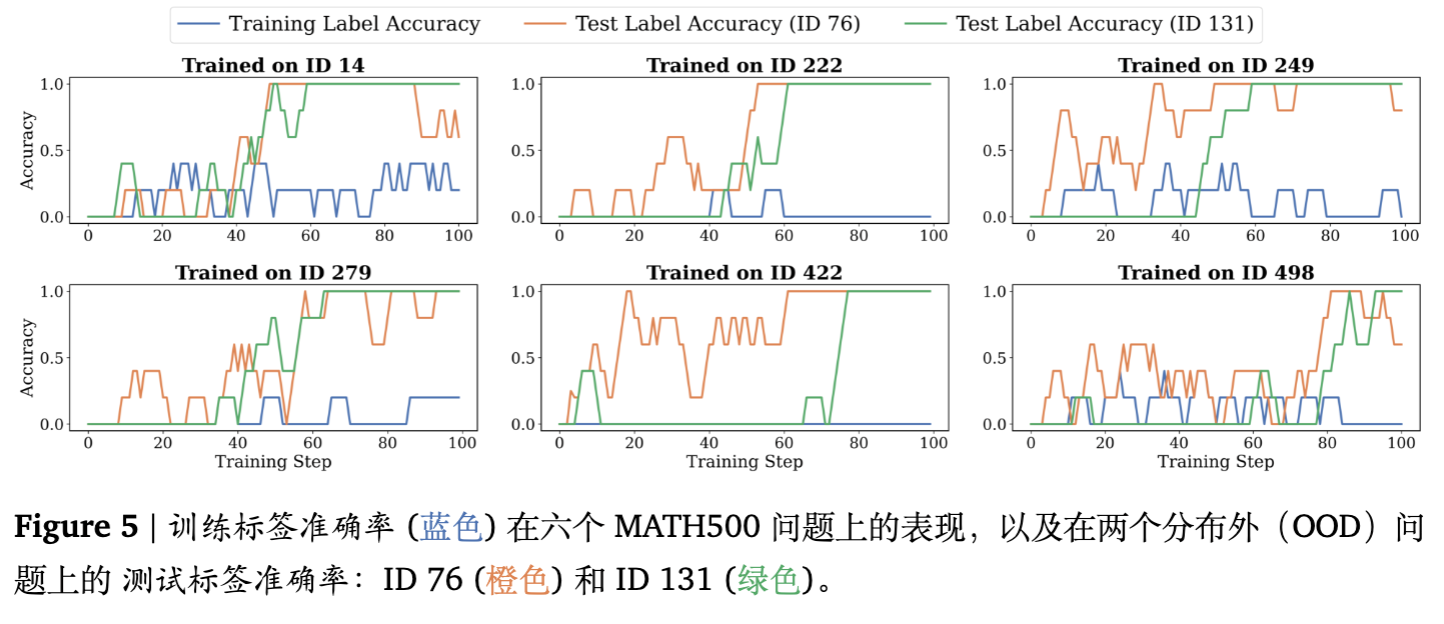

4.2.2 分布外(OOD)的跨题泛化

实验设置:在 6 道初始预测错误的 MATH500 题目上进行高度受限的强化学习。在不重叠的 2 道测试题(ID 76 和 131)上评估泛化性。

实验结果:图 5 显示,尽管训练题本身因为放大失败而保持较低的标签准确率,但测试题的准确率却从 0 稳步上升至 1。这表明,即便锐化机制在训练集上放大了错误,但由于模型对这些推理路径进行了强化,只要在未知测试题上初始置信度与正确性是对齐的,这种锐化依然能够产生正向泛化增益。

5. 如何安全应用内在 URLVR 的锐化机制?

由于内在 URLVR 存在崩溃的风险,研究分析了其在特定条件下安全应用的可能。

5.1 小数据集防止模型崩溃

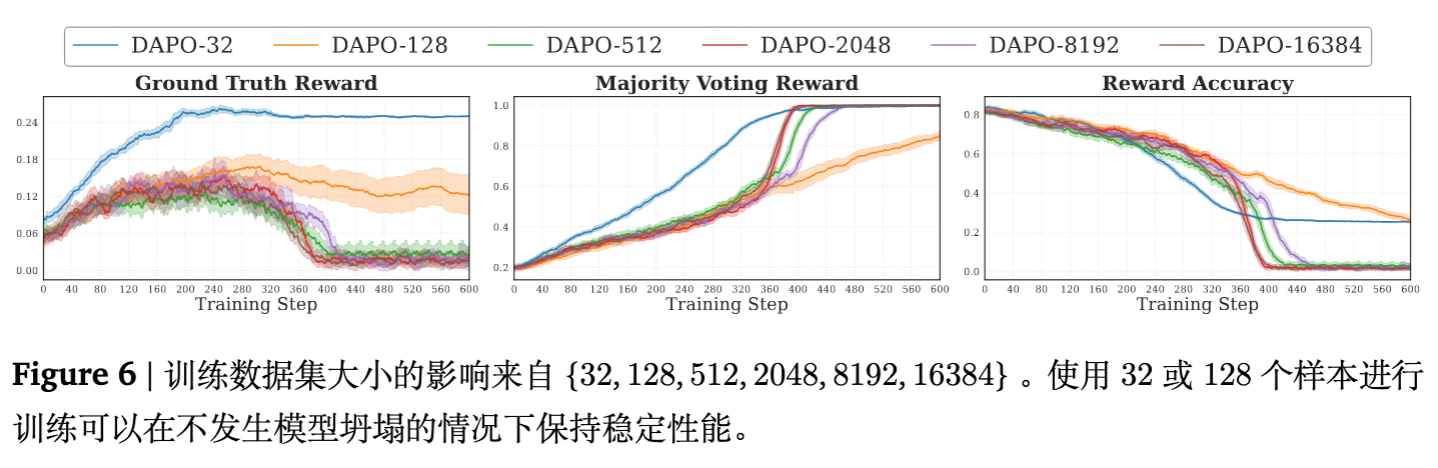

实验设置:在 DAPO-17k 的不同大小子集({32, 128, 512, 2048, 8192, 16384})上训练 Qwen3-1.7B-Base 600 个优化步。

实验结果:如图 6 所示,数据量 样本时表现稳定不崩溃,且多数投票奖励接近 1;而数据量 的集合则出现奖励作弊。

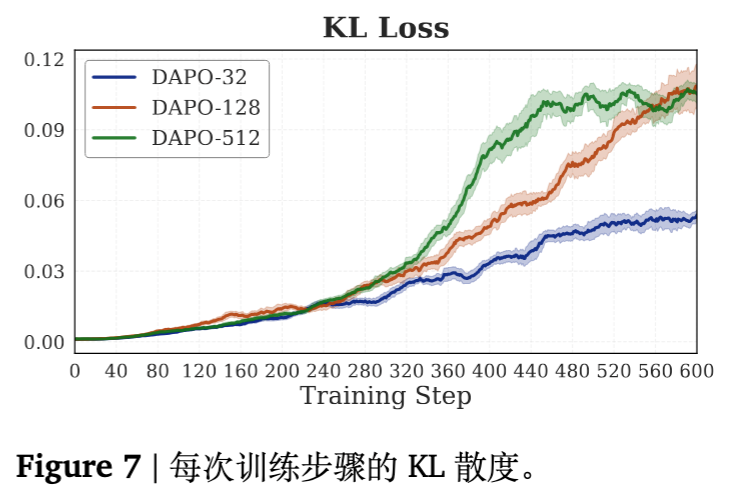

分析:如图 7 所示,小数据集引发的是局部的过拟合(Localized Overfitting)而非系统性的策略漂移(Systematic Policy Shift)。32 个样本在 600 步后的 KL 散度仅为 0.057,模型保留了其全局策略,进而维护了在 AIME24/AMC23 上的泛化性能。而大数据集要求密集的参数更新,导致了灾难性遗忘与全局崩溃。

5.2 测试时训练(Test-Time Training)作为安全应用场景

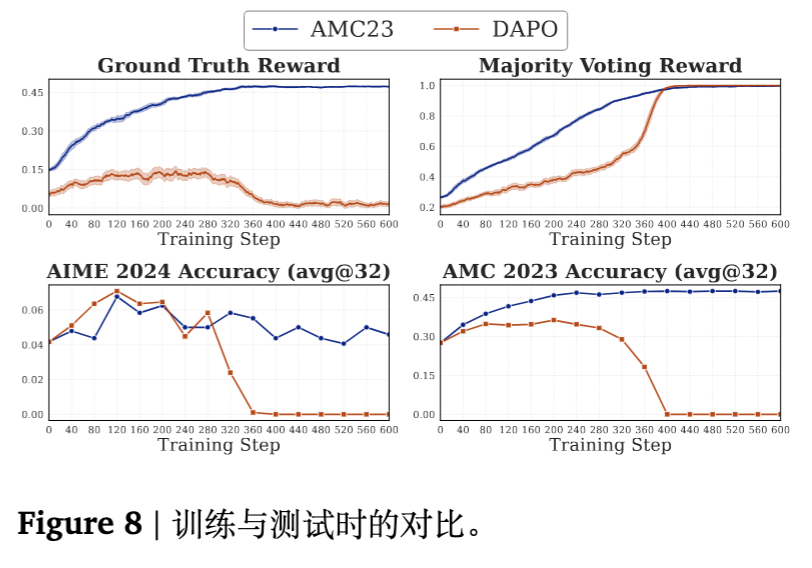

由于小数据集不会引发崩溃,测试时训练(只在评估目标域的小规模无标签数据上微调)成为一种自然的应用。如图 8 所示,在仅包含 40 题的 AMC23 上使用多数投票训练,真实奖励和代理奖励同步上升且未发生崩溃,同时在 AIME24 上取得正向迁移。这解释了为何近期多项利用内在奖励的工作(如 TTRL)都聚焦于测试时设定。

5.3 错误的初始多数票依然能改善推理

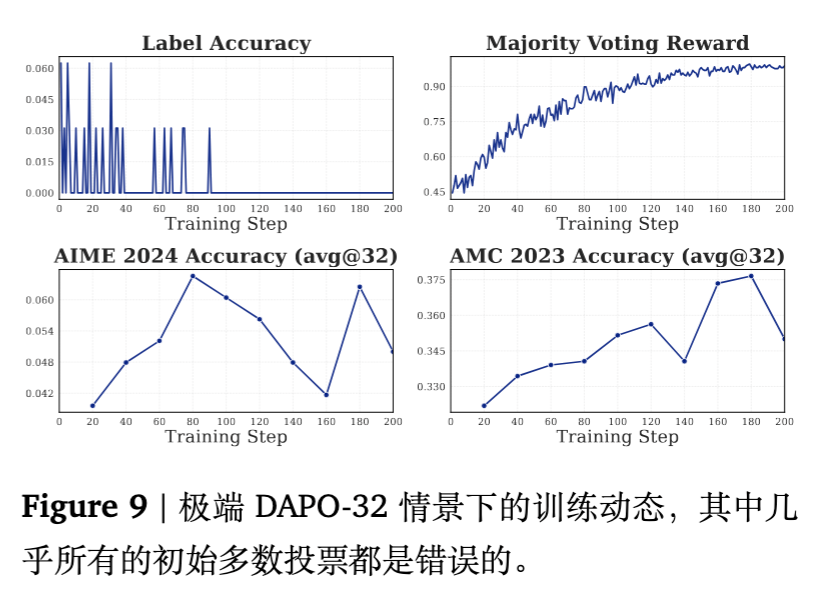

图 9 展示了当强制过滤出初始大多数投票错误的 32 个样本进行训练时,虽然这 32 个样本上的标签准确率几乎为零,但训练依然没有灾难性崩溃,且在 AIME24 和 AMC23 上获得了性能提升。这与跨题泛化的结论一致,进一步确认了小规模子集上的局部更新能够安全提取收益。

6. 衡量模型先验:模型崩溃步数(Model Collapse Step)

既然内在 URLVR 的成败取决于模型的初始置信度是否与正确性对齐,那么我们能否反过来,利用 URLVR 的这一动态特性来衡量“模型先验(Model Prior)”的强弱?

6.1 不同模型的预试验

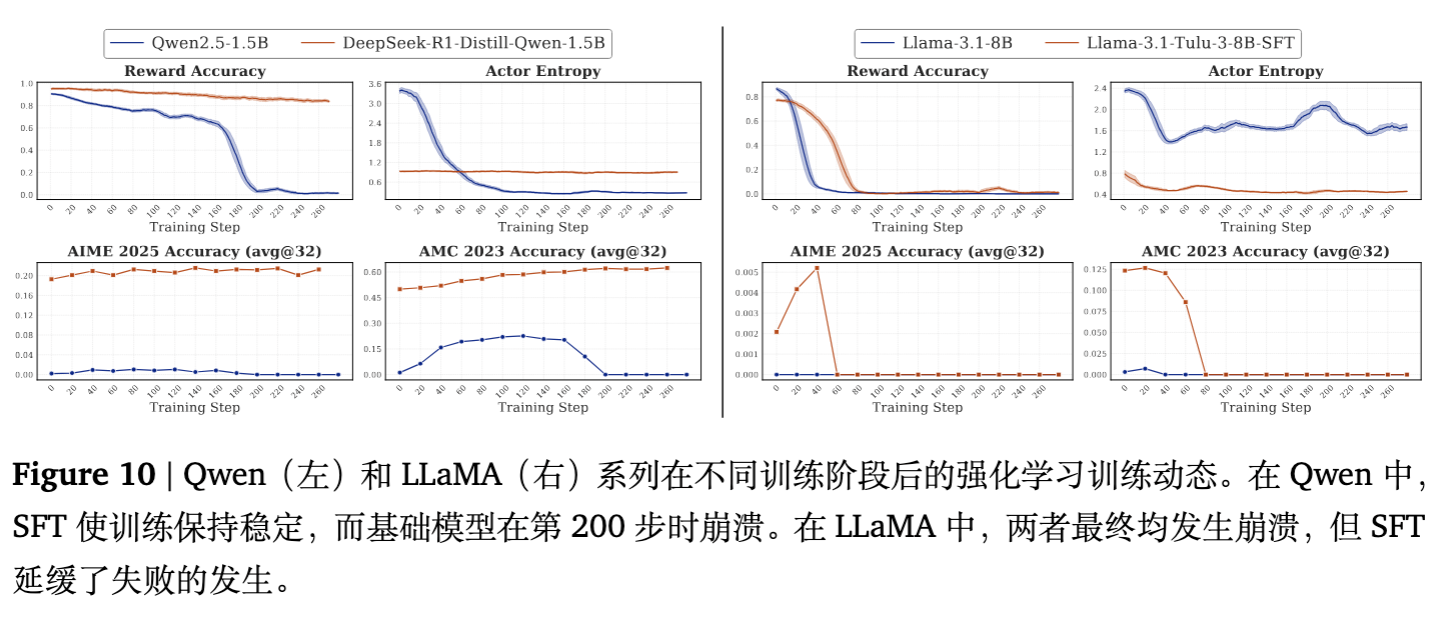

图 10 比较了 Qwen 和 Llama 家族中的 Base 模型和 SFT(监督微调)模型。

在 Qwen 家族中,SFT 变体在整个训练过程中维持高奖励准确率,而 Base 模型在 200 步左右崩溃。对于 Llama 家族,两者的表现均会崩溃,但 SFT 变体的抗崩溃时间更长。有趣的观察是,Base 模型初始拥有更高的 Actor Entropy,但表现反而更差且崩溃更早。这说明初始高熵并不能单独预测模型的 RL 可训练性;熵的下降是锐化过程的“结果”而非“决定因素”。

6.2 模型崩溃步数准确预测 RL 增益

基于这一现象,本文提出 模型崩溃步数(Model Collapse Step) 作为评估模型 RL 可训练性的指标。该指标定义为:使用默认超参数进行多数投票内在 URLVR 训练时,奖励准确率(Reward Accuracy)跌破 1% 的训练步数。

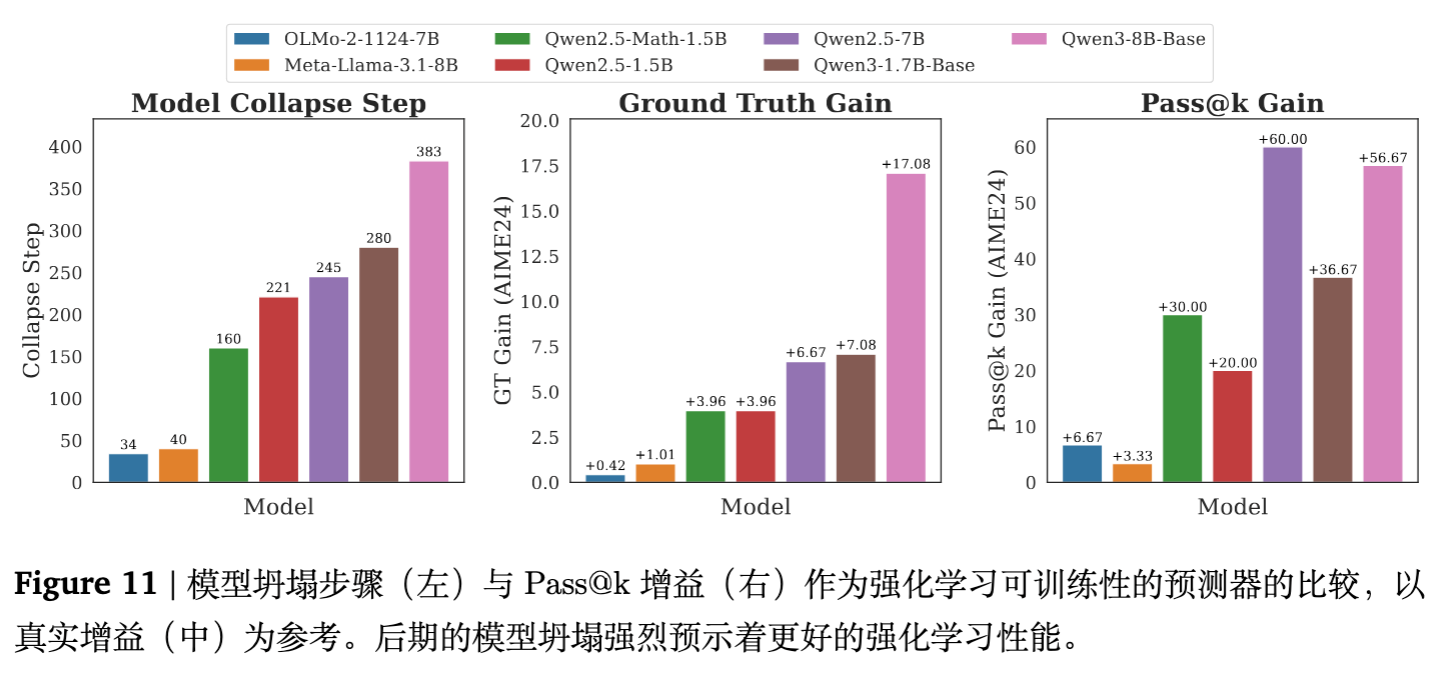

实验结果:图 11 显示,针对 7 个不同模型评估发现,模型崩溃步数与标准的监督 RL 性能增益(GT Gain)表现出强正相关。生存步数越长的模型(即崩溃步数大),在标准 RL 训练中取得的效果越好。相比传统的 pass@k 评估,模型崩溃步数的预测准确度更高,且不易在多项选择题上出现伪高分,具备更优的可靠性。

6.3 快速预测 RL 增益

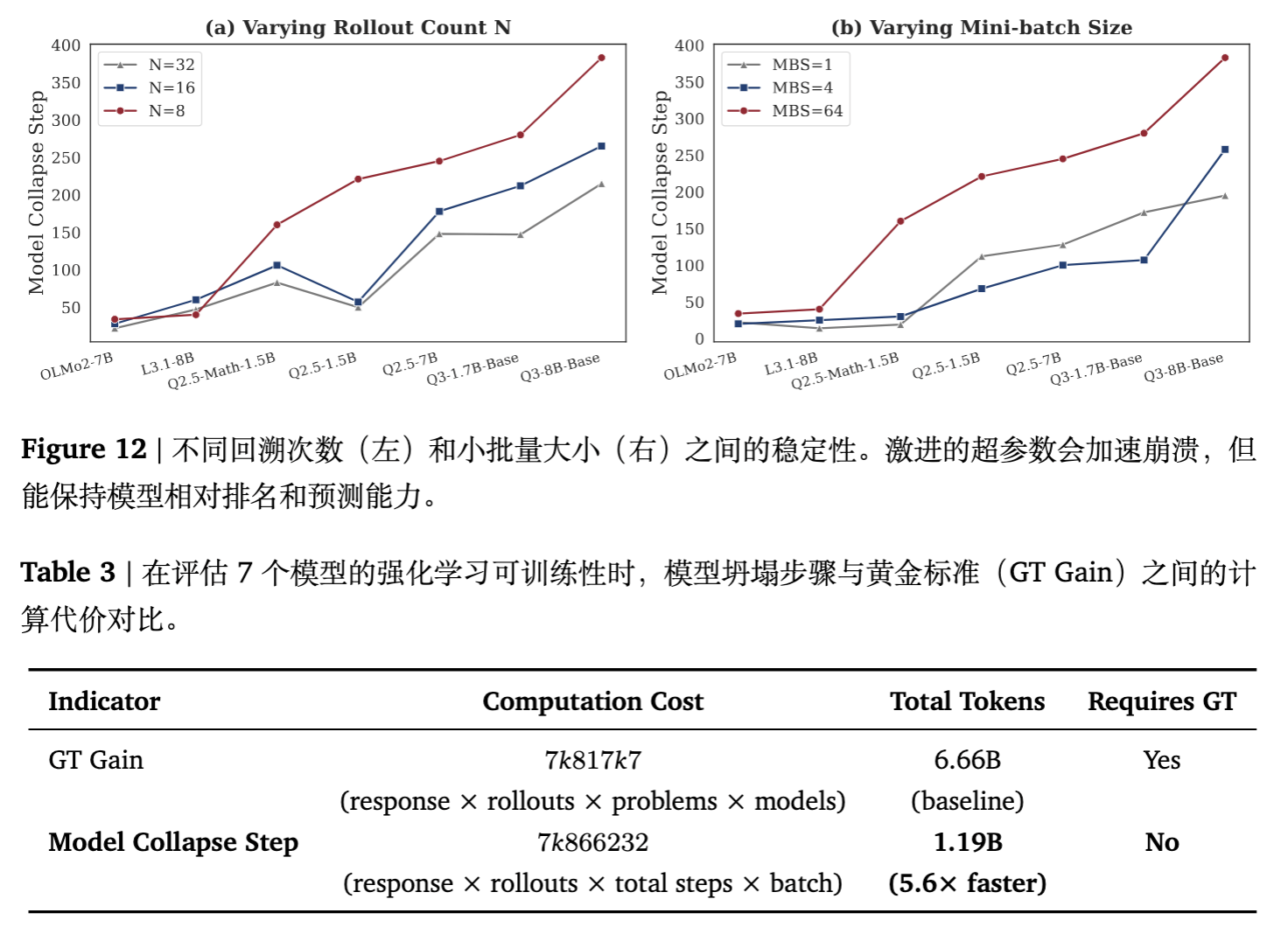

为了使该指标更具实用性,本文测试了具有侵略性(Aggressive)的超参数(如 mini-batch=1 或 N=32)是否能加速测量过程。

图 12 证实,虽然激进的超参数加速了绝对崩溃步数,但各个模型之间的相对排名保持高度稳定。表 3 显示,该指标无需真实标签,且总 Token 计算开销仅为标准 RL 的 (1.19B vs 6.66B Token)。

7. 讨论:外部奖励提供可扩展路径

前文证实了内在奖励受制于置信度-正确性对齐的内在瓶颈。当对齐较弱时,它只是放大偏见而非发现新知识。这意味着其受限于模型自身的知识边界,无法无限制扩展。

与之相对,外部奖励则提供了一条不受模型能力饱和限制的路径。[表 2.2 节] 提到的利用未标记数据和生成-验证不对称性就是典型范式。外部验证器(如代码编译器或定理证明器)不会随着模型能力的增强而变得更弱或产生幻觉。

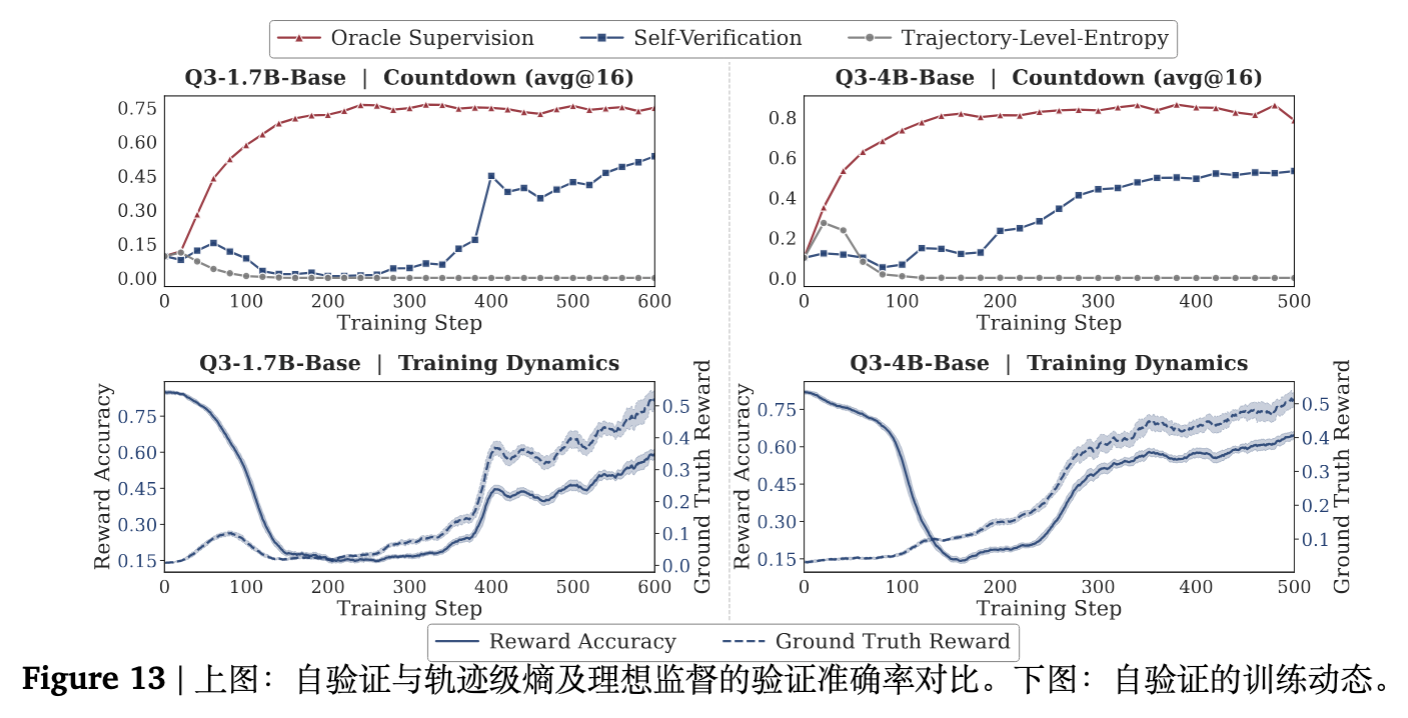

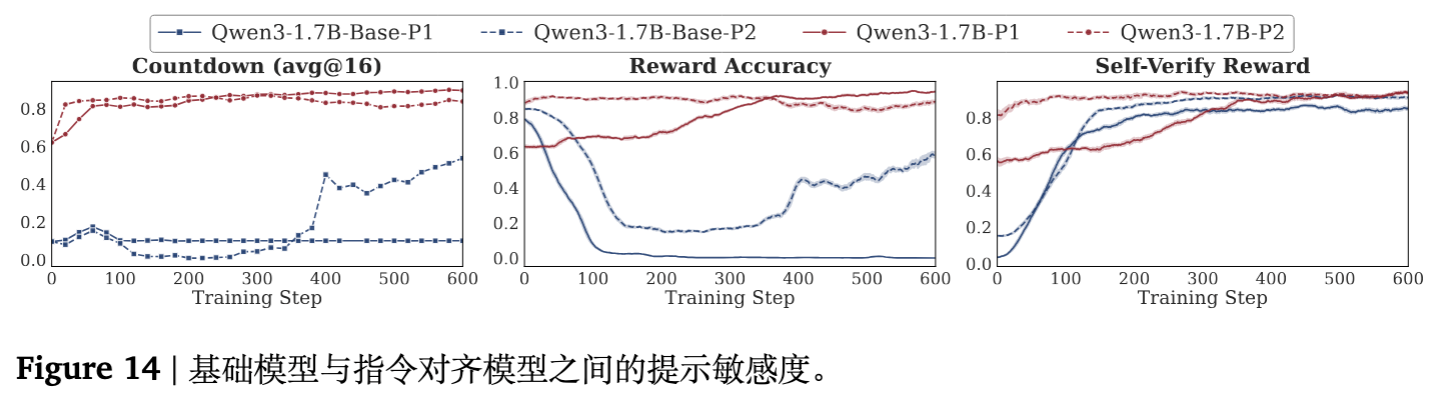

为了验证外部奖励在实际中的优势,本文考察了自我验证(Self-Verification) 案例。在 Countdown 算术任务中,生成等式困难但验证计算结果极简。

模型生成解后,调用一个验证提示词让其充当验证器输出对错(见附录 C.1 的 Prompt 1 和 2)。

实验结果:

-

如图 13 所示,Self-Verification 明显优于 Trajectory-Level Entropy。在训练动态中,Reward Accuracy 虽然在 200 步时出现下降(模型试图欺骗验证器),但随后恢复并稳定在 0.5 以上,同时 Ground Truth Reward 持续上升。这种自我修正能力表明模型正在真实学习如何解决问题并抵抗奖励作弊。 -

如图 14 所示,指令对齐能力是自我验证成功的关键。SFT 指令模型对验证提示的选择更具鲁棒性,而基础模型表现出高度敏感性。

结论:外部奖励由于锚定在不随模型优化而退化的客观验证过程上,具备规模化扩展的天然优势。无标签语料的巨大规模与计算验证的廉价性,提供了突破人力标注瓶颈的新可能。

8. 总结

本文系统探究了无监督 RLVR 扩展 LLM 训练的能力边界。理论与实证表明,所有内在奖励方法均共享“锐化”的底层机制,导致输出分布趋于确定性并最终不可避免地引发模型崩溃。因此,内在 URLVR 无法无限制地扩展以创造新能力,但对于测试时训练中的知识提取依然是安全实用的。此外,基于崩溃的训练动态,提出的模型崩溃步数指标为评估 RL 可训练性提供了一种快速且准确的预测方法。未来向可扩展 URLVR 的演进,应更多聚焦于探索能够利用生成-验证不对称性和无监督数据的外部奖励机制。

附录

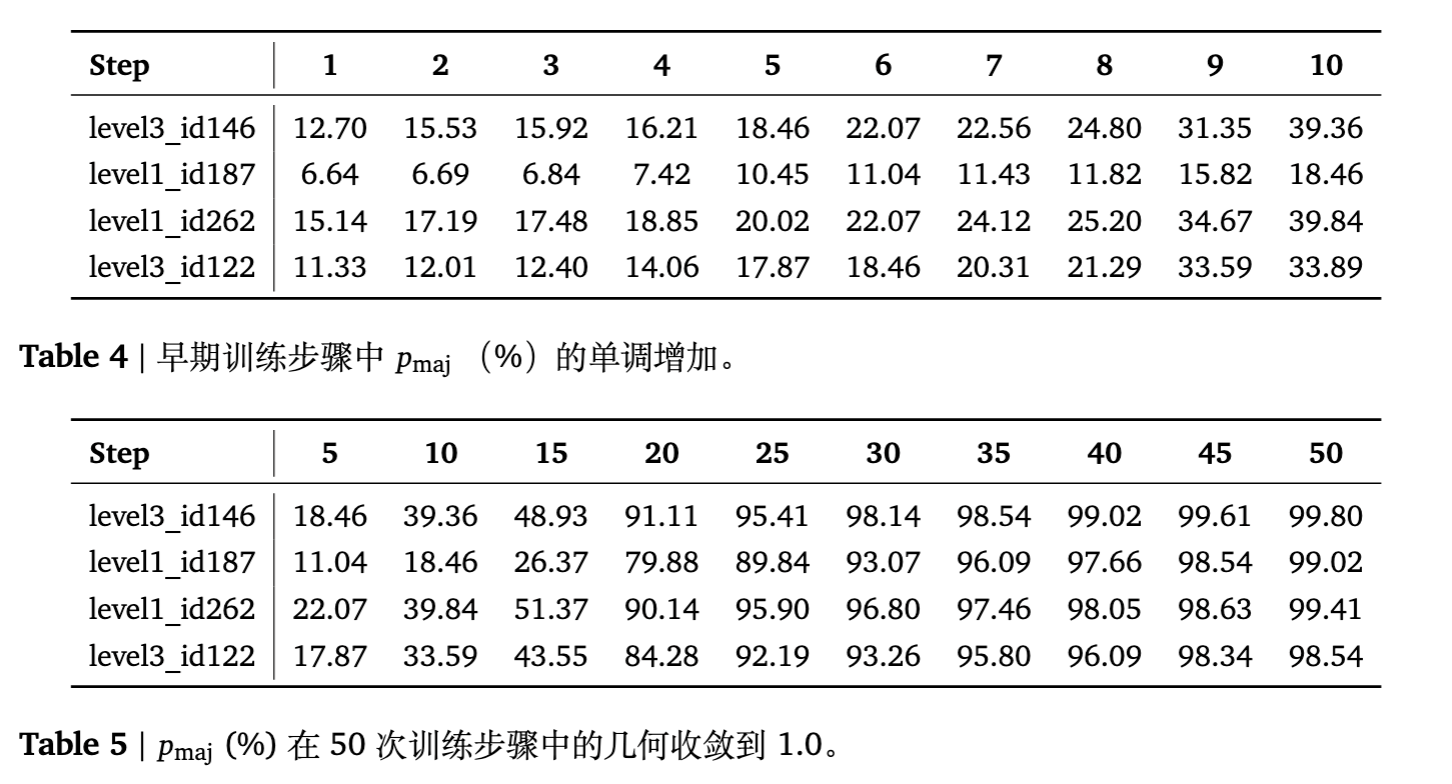

A.1 定理 1 中不等式的严密论证

在定理 1 中,假设单次随机梯度下降更新使得 成立。

-

下界成立:策略梯度表示为 。多数轨迹的奖励为 1,非多数为 0。使用学习率 的更新后,仅多数轨迹的概率得到正向优势项的提升,因此总概率质量增加,下界 成立。 -

上界成立:目标函数求最大值得到的最优策略 代表理论可达到的最高概率质量。由于采用受控的单步更新,其增幅不会超越该理论最高点。 -

经验验证:通过在 MATH-500 上对 1024 个 rollout(减小随机性)的实证,表 4 和表 5 验证了 50 步内的严格单调递增现象(收敛至 98.54%-99.80%),且多数答案()始终保持不变。

A.5 其他内在奖励诱导的最优策略推导

统一奖励框架表明,其他方法亦表现出锐化效应,其针对不同奖励项诱导的最优策略具体推导如下:

1. Self-Certainty 奖励 :

奖励定义包含了与均匀分布 的 KL 散度:

代入闭式目标:

当模型对输出赋予高度集中的概率时,指数项变大,模型对自身生成的内容“自信度”得到系统性提升。

2. Token-Level Entropy 奖励 :

对于高熵分布,奖励为显著负值,压制概率;对于低熵尖峰分布,奖励接近 0,归一化后概率得到提升。

3. Trajectory-Level Entropy 奖励 :

赋予序列已有较高先验概率的样本更高的归一化权重,直接放大现有偏好。

4. EMPO 奖励 :

在答案空间上进行加权重分配,系统性地将概率质量转移至先验高概率区域。

B.3 详尽的超参数调优消融分析

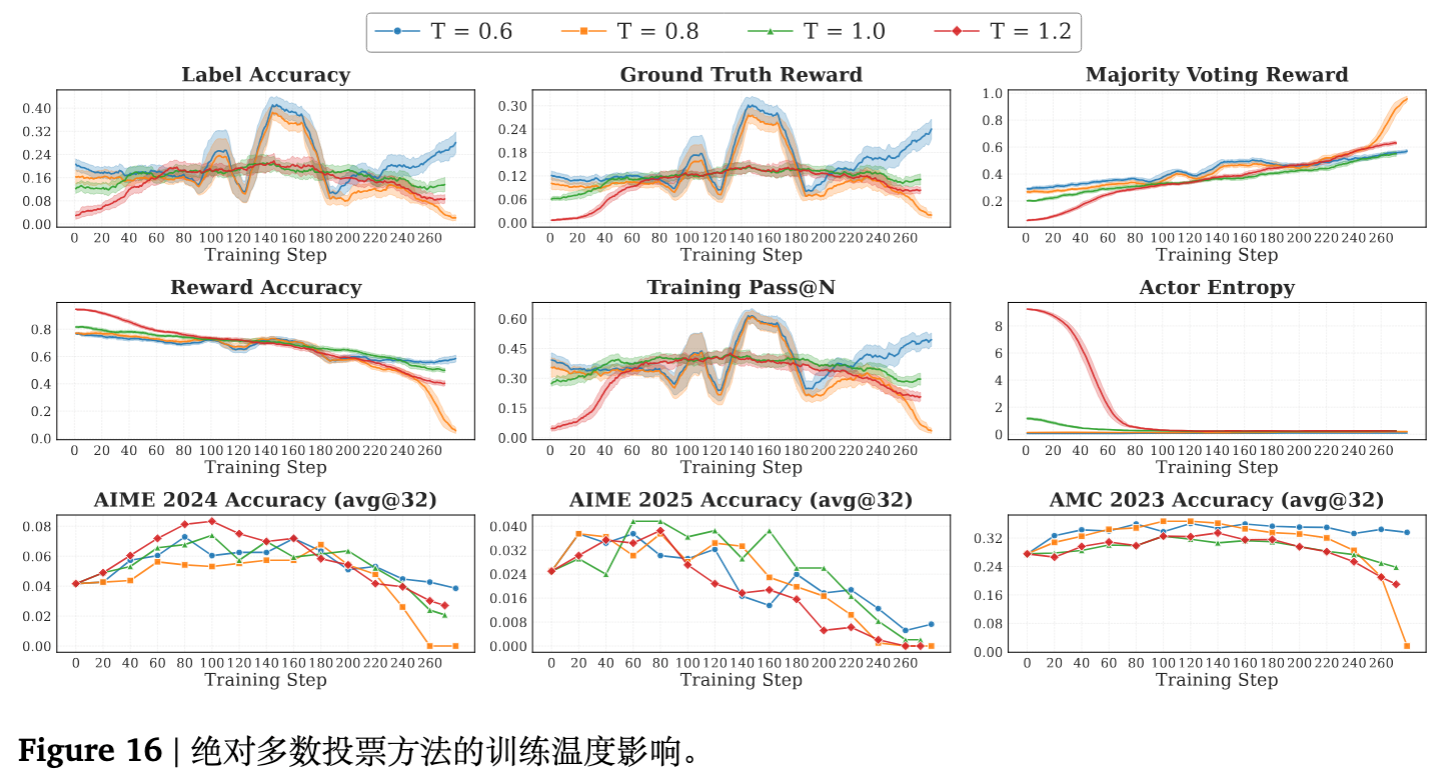

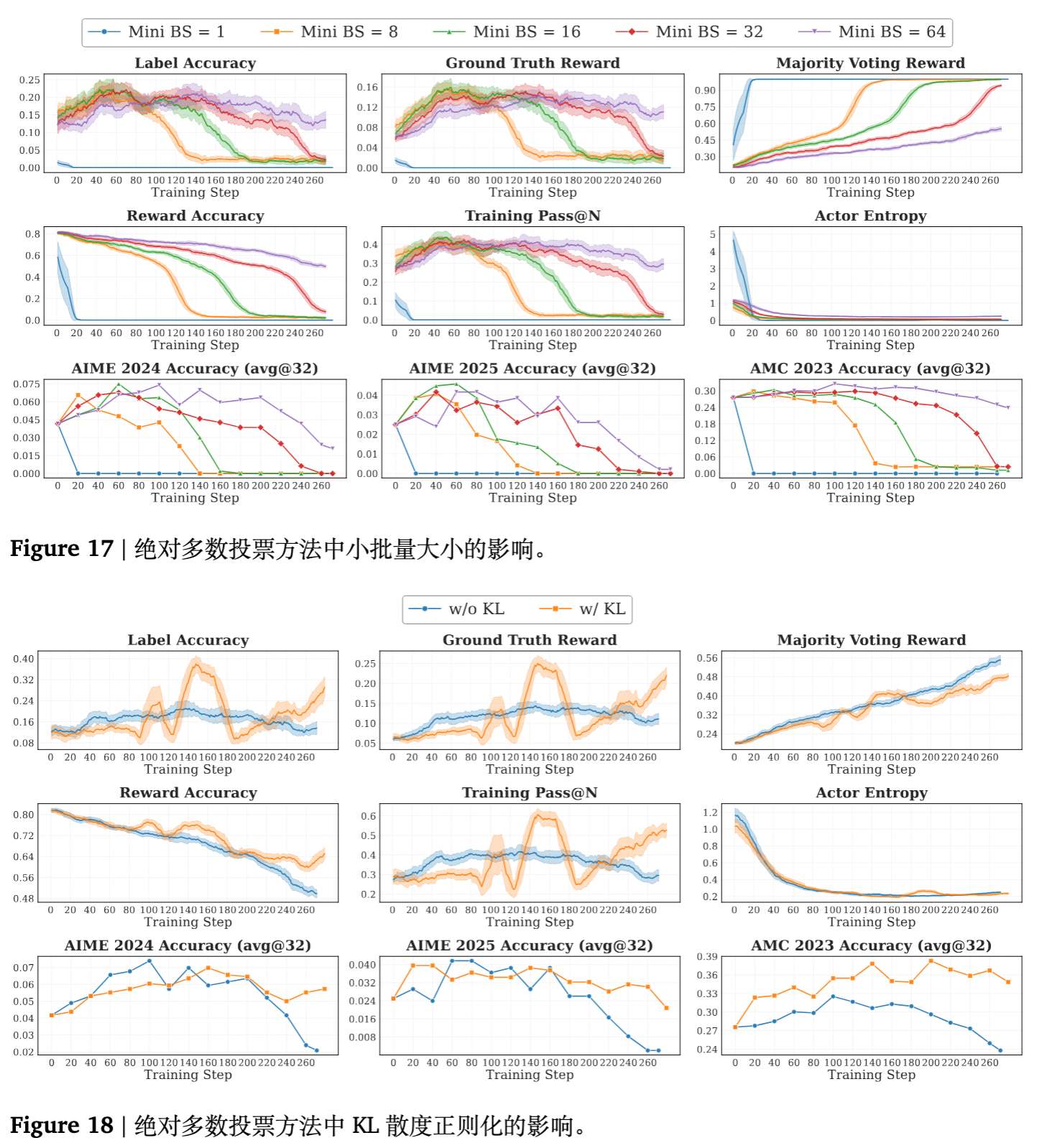

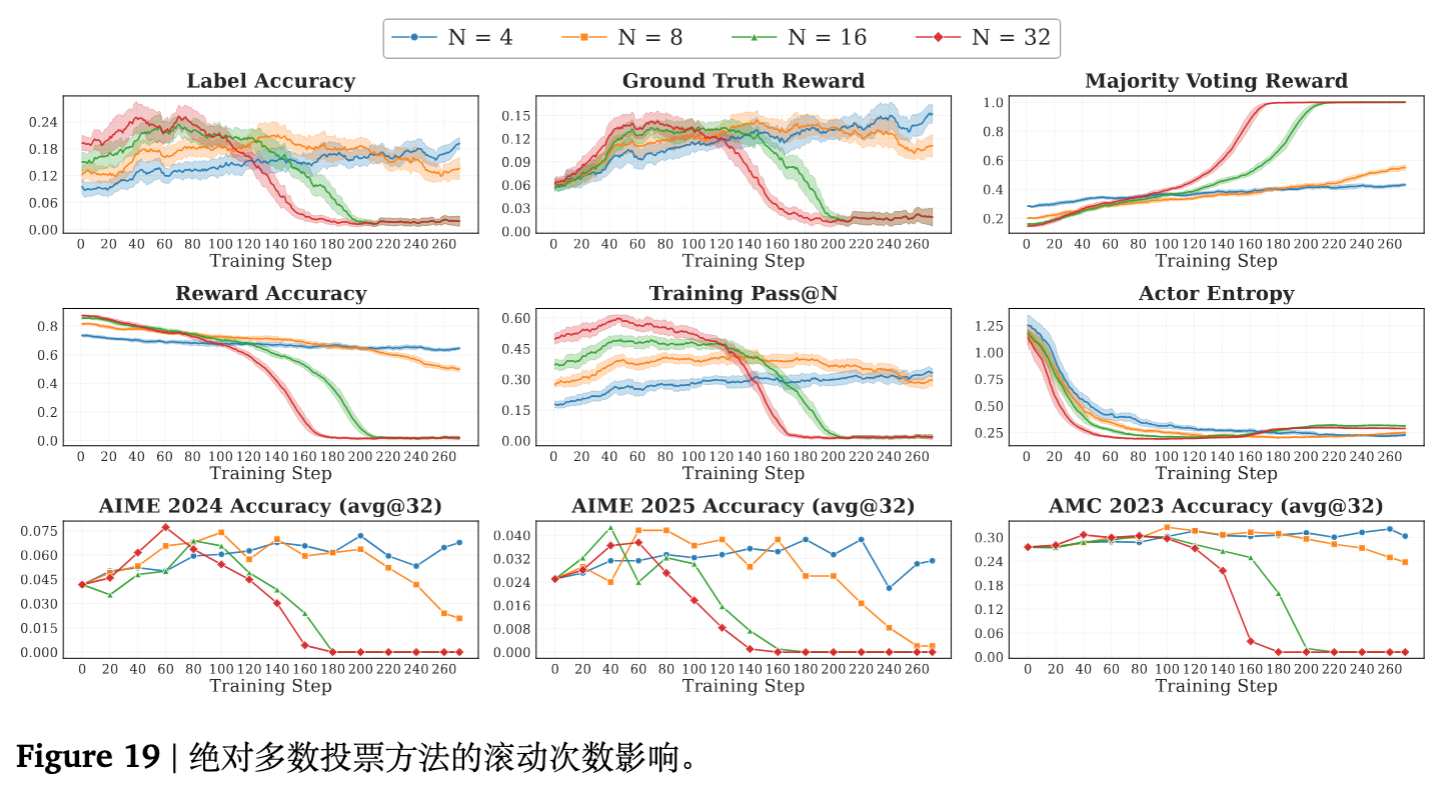

为了证明崩溃并非超参数的设定失误,作者对温度(T)、微批次大小(Mini-Batch Size, BS)、KL 正则化(KL)、和采样次数(Rollout Number, N)进行了全方位的消融。

多数投票(Majority Voting)消融分析

-

温度(Temperature):影响探索多样性。图 16 表明,低 T (0.6, 0.8) 会加速 Logits 锐化,导致标签准确率更早崩盘。T=1.2 能维持探索但峰值性能有损。T=1.0 提供了稳健的权衡。 -

微批次大小(Mini-batch Size):影响在轨(on-policy)更新的一致性。图 17 显示,纯 on-policy (BS=64) 稳定性最佳。BS=1 会因奖励陈旧(Staleness,使用 评估旧样本)在 20 步内迅速导致崩溃。 -

KL 正则化:理论上应延缓收敛。图 18 中,加入 KL 仅带来了微弱的早期收益增加,崩溃延迟(约 40 步)有限,且训练方差增大。 -

采样次数(Rollouts):影响投票可靠性。图 19 揭示,随着 N 增大(32 或 16),奖励放大效应更强,加速了模型的早期收敛,但也使模型在 180-220 步时迅速崩溃。N=8 平衡了统计可靠性与稳定性。

基于确定性的方法(Certainty-Based Methods)消融分析

确定性方法对超参数表现出不同于多数投票的敏感度模式。

-

温度(Temperature):高温度 (T=1.2) 显著延缓了 Token-Level、Trajectory-Level Entropy 和 Probability 的崩溃。但 Self-Certainty 呈现反差:T=1.2 导致探索过度无法收敛,T=1.0 性能更佳。这说明基于熵的方法从高温探索中获益最大。 -

微批次大小(Mini-Batch Size):大 BS 避免过早崩溃依然适用。不过,Self-Certainty 对小 BS 呈现出极强的鲁棒性(相比其他方法),原因是其依赖分布对比而非显式概率估计,降低了对时序不一致性的敏感度。 -

KL 正则化: KL 对确定性方法的作用同样微乎其微,说明旨在针对固定奖励信号设计的正则化手段,无法有效稳定奖励随策略变化的自我迭代系统。 -

采样次数(Rollouts):高 N 对 Entropy 类方法的加速崩溃作用。但 Self-Certainty 表现出异常稳定的趋势,维持了一致的性能而未发生显著崩溃。

C 骨干网络与数据集深层影响

C.2 骨干网络影响(Backbone Model Impact)

采用 11 个涵盖 Qwen 和 Llama 不同大小与训练阶段的模型,绘制出多维度的稳定性格局。

-

水平分析(训练阶段影响):在 Qwen 中,数学特化和 SFT 模型在保持多数投票奖励稳定在 0.3-0.6 区间具有优势;而 Base 和 Instruct 模型更易触及饱和状态(1.0)。Llama 模型则全系崩溃,进一步验证了架构级别的固有稳定性差异。 -

垂直分析(参数规模和代次影响):较小规模(1.7B 或 3B)比较大规模(4B 或 8B)在面临噪声代理奖励时存活更久,呈现了反直觉的缩放效应:大容量模型更容易捕获病态解。同时, Qwen3 系列凭借更优的不确定性校准,表现出更加渐进的训练动态。

C.3 训练数据集的影响

利用 MATH-8k、DeepScaleR-40k、DAPO-17k 和 ORZ-56k 等不同语料库进行评估。当拓展到更大规模的预料(如 40k 和 56k)时,模型展现了极其明确的奖励作弊趋势。小规模数据带来的阶段性涨幅,在拓展训练周期和数据规模时,不可避免地陷入锐化的陷阱。

C.4 内在奖励是否真正提升了能力?

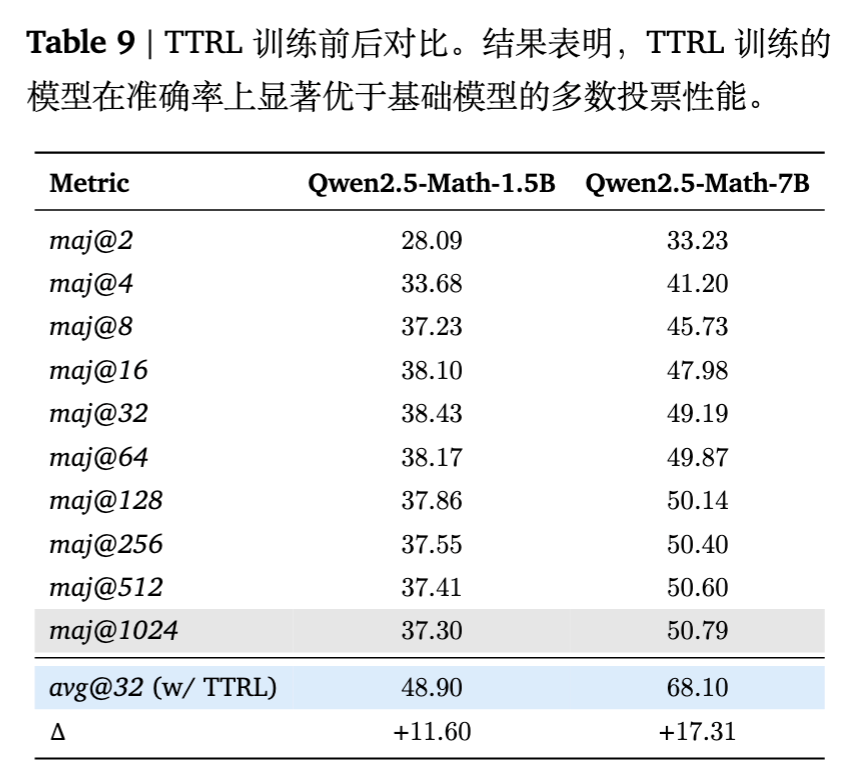

这是一个核心拷问:TTRL 这类方法是否仅仅让模型达到了其在多数投票条件下的性能上限(Self-consistency 上限)?表 9 通过对比基础模型通过多次采样得出的 maj@1024(近似 maj@∞ 上限)与 TTRL 训练后模型的 avg@32 表现,给出了答案。TTRL 训练后的 Qwen2.5-Math-1.5B 取得 48.90 的准确率,远超基础模型 maj@1024 的 37.30。这证实了:即便受限于内在机制,TTRL 依然实实在在地赋予了模型解决更广泛问题的新能力,而非仅仅是对齐内部一致性。