-

论文标题:Qwen3-VL Technical Report -

论文链接:https://arxiv.org/pdf/2511.21631

TL;DR

终于等来了 Qwen3-VL 系列的技术报告,今天解读一下。该系列模型建立在 Qwen3 语言模型基座之上,包含密集(Dense)和混合专家(MoE)两种架构,参数规模覆盖 2B 至 235B。Qwen3-VL 在架构设计、训练数据构建以及后训练策略上进行了多项改进。

核心技术要点:

-

架构升级: 引入 Interleaved-MRoPE 以解决长视频理解中的频谱偏差问题;采用 DeepStack 机制将多层视觉特征注入 LLM 层以增强细粒度感知;视频时间对齐从绝对位置编码转变为基于文本的时间戳(Text-based Video Timestamps)。 -

上下文长度: 原生支持 256K token 上下文,支持长文档和长视频理解。 -

数据工程: 构建了大规模的 OCR、文档解析、视觉定位(Grounding)、以及专门针对 STEM 和代码的合成数据管线。 -

思考模式(Thinking Mode): 引入了类似 System 2 的长思维链(Long CoT)训练,在多模态推理任务上表现出性能提升。 -

性能表现: 在 MMMU、MathVista、DocVQA 等多个基准测试中,Qwen3-VL-235B-A22B 取得了与 GPT-5、Claude Opus 4.1 等模型相当或更优的结果。

1. 引言

视觉-语言模型(VLMs)的发展正从基础的感知能力向复杂的推理、长上下文理解以及代理(Agent)交互方向演进。Qwen3-VL 的设计目标是在保持底层 LLM 语言能力的同时,提升多模态任务的推理与交互能力。

Qwen3-VL 系列包含以下变体:

-

Dense 模型: Qwen3-VL-2B, 4B, 8B, 32B。 -

MoE 模型: Qwen3-VL-30B-A3B (Active 3B), Qwen3-VL-235B-A22B (Total 235B, Active 22B)。

所有模型均支持 256K 的上下文窗口。训练过程分为预训练(Pre-training)和后训练(Post-training)两个阶段,并在后训练阶段区分了非思考(Non-thinking)和思考(Thinking)两种变体。

2. 模型架构

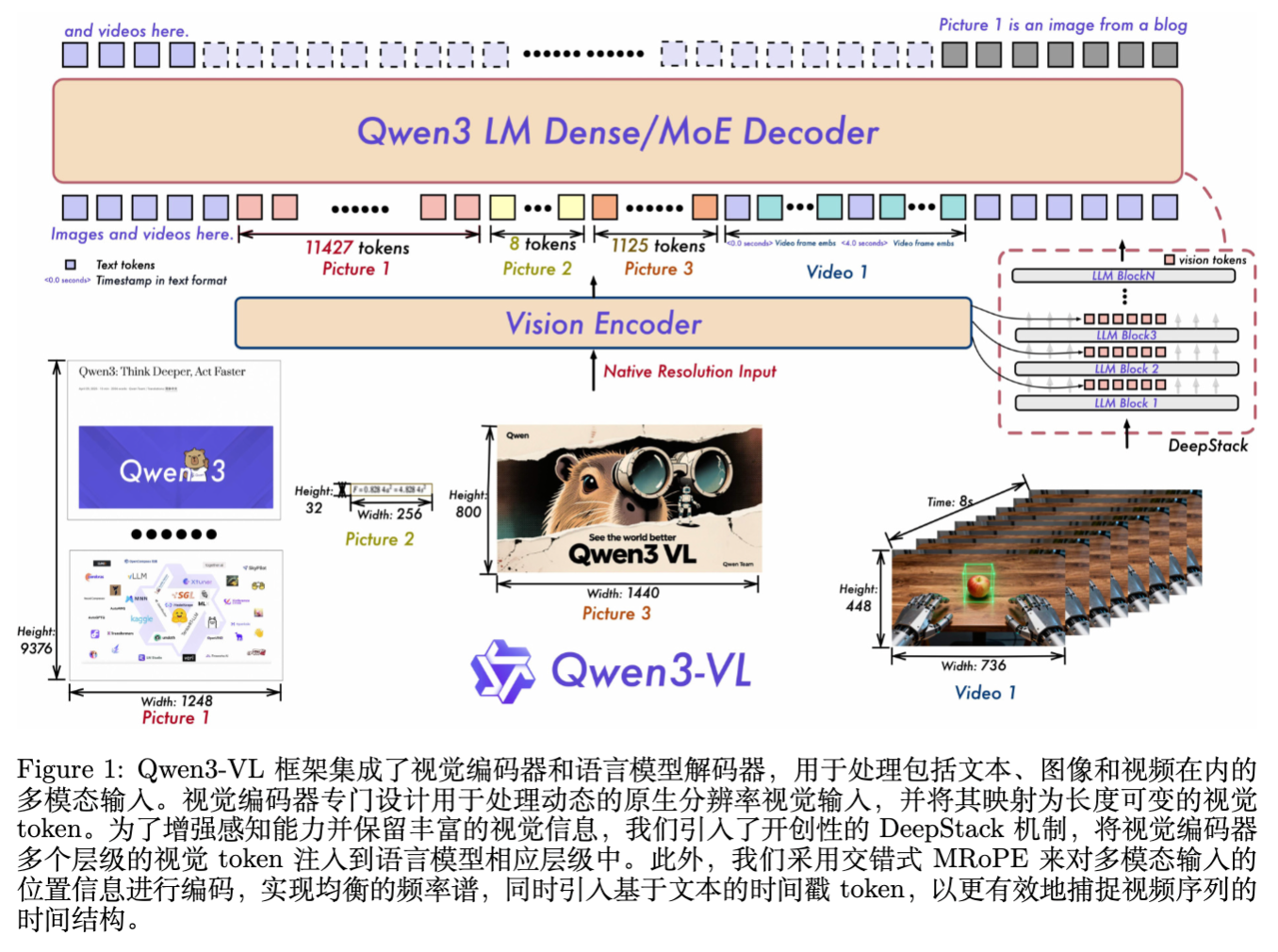

Qwen3-VL 沿用了 Qwen2.5-VL 的三组件架构:视觉编码器(Vision Encoder)、MLP 视觉-语言适配器(Merger)以及大型语言模型(LLM)。在此基础上,团队引入了三项关键架构改进。

2.1 视觉编码器与输入处理

视觉编码器(Vision Encoder):

模型采用了 SigLIP-2 架构。对于大规模模型,默认使用 SigLIP2-SO-400M 变体;对于 2B 和 4B 的小规模模型,则使用 SigLIP2-Large (300M)。为了适应不同分辨率的输入,模型采用了动态分辨率训练策略,并结合 2D-RoPE 对位置嵌入进行插值,以处理不同尺寸的图像。

MLP 适配器:

使用两层 MLP 将视觉编码器输出的 特征块压缩为单个视觉 token,从而与 LLM 的隐藏层维度对齐。

2.2 DeepStack 跨层融合机制

为了加强视觉与语言模态的对齐,Qwen3-VL 引入了 DeepStack 机制。

-

设计动机: 传统的 VLM 通常仅将视觉编码器的最终层输出作为 LLM 的输入。这种方式可能丢失视觉编码器中间层包含的低级或细粒度视觉信息。 -

实现方式: 模型从视觉编码器的不同层级提取特征。这些多级特征经过专用的适配器投影后,通过轻量级的残差连接注入到 LLM 的前三层隐藏状态中。 -

优势: 这种设计不增加额外的上下文长度,但在不显著增加计算开销的情况下,增强了模型对多尺度视觉特征的利用能力。

2.3 交错式多维旋转位置编码 (Interleaved MRoPE)

Qwen2.5-VL 引入了 MRoPE 来处理多模态位置信息,将嵌入维度划分为时间(t)、水平(h)和垂直(w)三个子空间。

问题分析:

原有设计将 embedding 维度分块(Chunking),分别分配给 t, h, w。研究观察到,这种分块策略会导致频率谱(Frequency Spectrum)不平衡。具体而言,某些维度可能只包含低频信息,而其他维度包含高频信息,这会损害长视频理解能力。

改进方案:

Qwen3-VL 采用了交错式(Interleaved)设计。通过在嵌入维度上交错分配 t, h, w 的分量,确保每个时空轴在低频和高频波段上都有均匀的表示。

假设嵌入维度为 ,对于每个位置索引 ,其编码方式通过交错频率确保了频谱偏差的缓解,从而提升了模型对长距离时空依赖的建模能力。

2.4 基于文本的视频时间戳 (Explicit Video Timestamps)

在视频理解任务中,Qwen2.5-VL 使用绝对时间位置编码。

原有局限:

-

对于长视频,绝对时间位置 ID 会变得非常大且稀疏,影响长上下文外推。 -

需要对不同帧率(FPS)进行广泛采样以学习时间对应关系,增加了数据构建成本。

新方案:

Qwen3-VL 移除了基于位置编码的绝对时间对齐,转而采用显式文本时间戳 token。

-

每个视频时间片段前会插入格式化的文本字符串,例如 <3.0 seconds>。 -

训练过程中,同时使用秒(Seconds)和时分秒(HMS)格式,以增强模型对不同时间表示的鲁棒性。 -

虽然这略微增加了上下文长度(Text tokens),但它提供了更直接的时间语义,有助于视频定位(Grounding)和密集描述(Dense Captioning)任务。

3. 预训练策略 (Pre-Training)

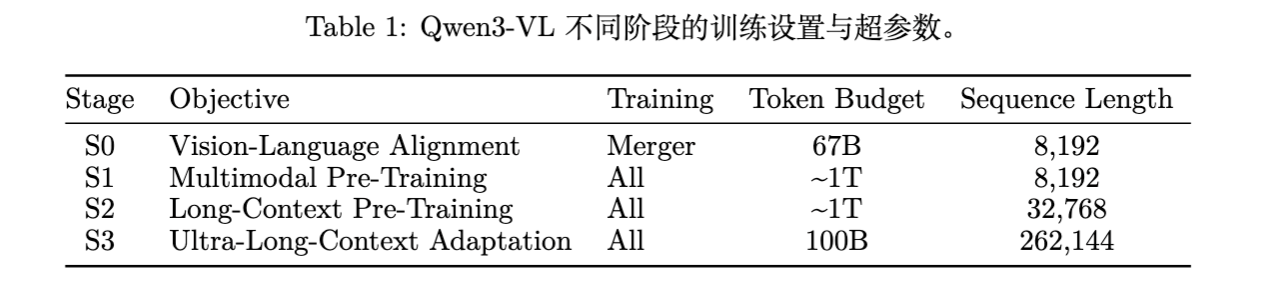

预训练阶段旨在赋予模型广泛的视觉理解能力和长上下文处理能力。训练过程分为四个阶段(S0 - S3),逐步解锁能力。

3.1 训练阶段详解

-

S0: 视觉-语言对齐 (Vision-Language Alignment)

-

目标: 弥合视觉与语言模态的差距。 -

参数更新: 仅训练 MLP 适配器(Merger),冻结视觉编码器和 LLM。 -

数据: 约 67B token,包含高质量图文对、视觉知识和 OCR 数据。 -

序列长度: 8,192。

-

-

S1: 多模态预训练 (Multimodal Pre-Training)

-

目标: 全参数端到端训练。 -

参数更新: 解冻视觉编码器、Merger 和 LLM。 -

数据: 约 1T token。混合了纯文本数据和多模态数据(图文交错文档、视觉定位、VQA、STEM 数据)。 -

序列长度: 8,192。

-

-

S2: 长上下文预训练 (Long-Context Pre-Training)

-

目标: 扩展上下文窗口,增强长文档和视频理解。 -

序列长度: 提升至 32,768。 -

数据: 约 1T token。增加了纯文本长文档的比例,多模态数据中引入更多视频和 Agent 指令跟随数据。

-

-

S3: 超长上下文适应 (Ultra-Long-Context Adaptation)

-

目标: 极限扩展上下文能力。 -

序列长度: 提升至 262,144 (256K)。 -

数据: 约 100B token。专注于长视频和长文档分析任务。 -

优化: 使用平方根重加权(Square-root reweighting)策略来平衡文本和多模态数据的损失,避免某一模态主导梯度。

-

3.2 数据工程

Qwen3-VL 的核心竞争力很大程度上源于其精细的数据工程。

3.2.1 图像描述与交错图文

-

图像描述: 构建了大规模中英文图文对。使用微调后的 Qwen2.5-VL-32B 模型对原始 Web 文本进行重新描述(Recaptioning),生成包含对象属性、空间布局和上下文语义的详尽描述。通过语义去重和基于聚类的采样策略,确保数据的多样性和长尾概念的覆盖。 -

交错图文: 收集自中英文网站。引入了基于 Qwen 的轻量级评分器过滤低价值内容(广告、点击诱饵)。针对书籍类数据,使用 Qwen2.5-VL-7B 进行高精度解析,将文本与插图精确对齐。为了支持长上下文,将连续页面合并为长达 256K 的序列。

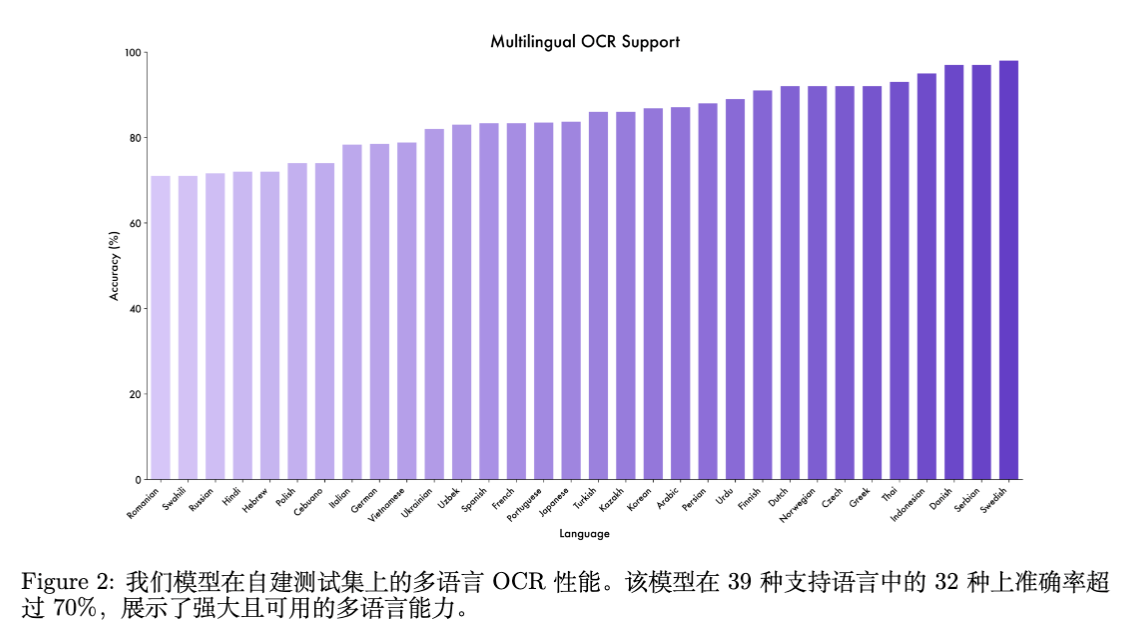

3.2.2 OCR 与文档解析

-

OCR: 收集了 3000 万内部数据。采用“粗糙到精细”的管道,结合 OCR 专用模型伪标签和 Qwen2.5-VL 的修正,无需人工标注。语言覆盖从 Qwen2.5-VL 的 10 种扩展到 39 种。 -

文档解析: 收集了 300 万 Common Crawl PDF 和 400 万内部文档。设计了统一的标注框架,支持 QwenVL-HTML(元素级边界框)和 QwenVL-Markdown(仅定位图片表格,表格转 LaTeX)两种格式。 -

长文档理解: 通过拼接单页文档合成长文档解析序列,并构建长文档 VQA 数据,要求模型跨页推理。

3.2.3 视觉定位与计数

-

Box-based Grounding: 整合 COCO, Objects365 等开源数据集,并开发自动化合成管道:使用 Qwen2.5-VL 提取候选对象 -> Grounding DINO 定位 -> 质量过滤。 -

Point-based Grounding: 整合 PixMo 及合成数据,专注于细粒度细节。 -

计数: 包含直接计数、基于框的计数和基于点的计数任务。坐标系统归一化到 。

3.2.4 空间理解与 3D 识别

-

空间理解: 构建包含关系标注(如“杯子在笔记本左边”)、功能性标签(Affordance,如“可抓取”)和动作条件查询(Action Planning)的数据集。所有空间参考均相对于其他物体,而非绝对坐标。 -

3D Grounding: 收集室内外场景数据,转化为 VQA 格式。输出 9-DoF 3D 边界框。利用 Omni3D 统一相机坐标系,并合成描述性文本查询。

3.2.5 视频 (Video)

-

密集描述合成: 针对长视频,采用“短到长”策略生成时间连贯的故事级描述。 -

时空定位: 在对象、动作和人物层级进行标注。 -

数据平衡: 动态调整采样参数(FPS、最大帧数)以适应不同长度的视频,避免信息丢失。

3.2.6 STEM 与代码

-

STEM: 开发基于代码的渲染管道生成几何图表。生成了 100 万点定位样本和 200 万感知导向 VQA 对。 -

代码: 包含 UI 到 HTML/CSS 转换、SVG 生成、可视化编程挑战等任务。

4. 后训练

后训练阶段包括监督微调(SFT)和强化学习(RL),并将模型分为非思考(Standard)和思考(Thinking/CoT)两种模式。

4.1 监督微调

数据构成:

SFT 数据集约 120 万样本,文本与多模态数据比例约为 1:2。涵盖 8 个核心领域和 30 个细分领域。

策略:

-

分阶段训练: 先在 32K 长度下训练一轮,随后在 256K 长度下训练第二轮。长上下文数据包括数百页的技术文档和长达两小时的视频。 -

数据过滤: -

查询过滤(Query Filtering): 使用 Qwen2.5-VL 识别模糊指令。 -

响应过滤(Response Filtering): 结合规则过滤(去除重复、格式错误)和基于奖励模型的过滤(评估正确性、有用性和视觉相关性)。

-

4.2 思考模式冷启动

为了训练具有长思维链(Long Chain-of-Thought)能力的模型,团队构建了专门的冷启动数据集。

-

数据来源: 视觉-语言数学题、复杂 STEM 问题、Agent 工作流。多模态与纯文本比例约为 1:1。 -

多模态必要性过滤: 对于视觉数学题,剔除那些不看图仅凭文本就能被 Qwen3-30B-nothink 解出的题目,确保样本确实需要多模态推理。 -

难度筛选: 保留基线模型通过率低或生成回复较长的问题。

4.3 强弱蒸馏 (Strong-to-Weak Distillation)

采用两阶段蒸馏策略,利用强模型(Teacher)提升弱模型(Student)能力:

-

Off-policy Distillation: 学生模型学习教师模型的输出,建立基础推理能力。 -

On-policy Distillation: 学生模型根据提示生成响应,通过最小化与教师模型 logits 的 KL 散度进行微调。

注:蒸馏主要在纯文本数据上微调 LLM 骨干,这被证明能有效迁移推理能力到多模态任务。

4.4 强化学习 (Reinforcement Learning)

强化学习分为推理 RL 和通用 RL 两个阶段。算法采用 SAPO (Soft adaptive policy optimization,Qwen 团队推出 SAPO,相较于 GRPO、GSPO 稳定且更优)。

4.4.1 推理 RL

-

任务: 数学、代码、逻辑推理、视觉定位等具有确定性验证方法的任务。 -

奖励: 基于规则或代码执行器的二值奖励。

4.4.2 通用 RL

-

目标: 指令跟随(格式、长度约束)和偏好对齐(有用性、安全性)。 -

去学习(Unlearning): 引入特定任务纠正 SFT 阶段引入的错误先验(如反直觉的物体计数)。 -

混合奖励系统: -

基于规则的奖励: 用于可验证任务(如格式检查)。 -

基于模型的奖励: 使用 Qwen2.5-VL-72B-Instruct 或 Qwen3 作为裁判模型,对开放性问题进行评分。

-

4.5 Agent 能力:Thinking with Images

受 "Thinking with Images" 启发,Qwen3-VL 通过两阶段训练赋予模型 Agent 能力:

-

冷启动 SFT: 使用约 10k 简单的 Grounding 数据微调 Qwen2.5-VL-32B,模拟 思考 -> 行动 -> 观察 -> 回答的过程。 -

多轮 RL: 蒸馏第一阶段的模型生成 120k 多轮交互数据,并在 Qwen3-VL 上应用工具集成的 RL。 -

奖励信号: 答案正确性、多轮推理逻辑连贯性、工具调用准确性。

-

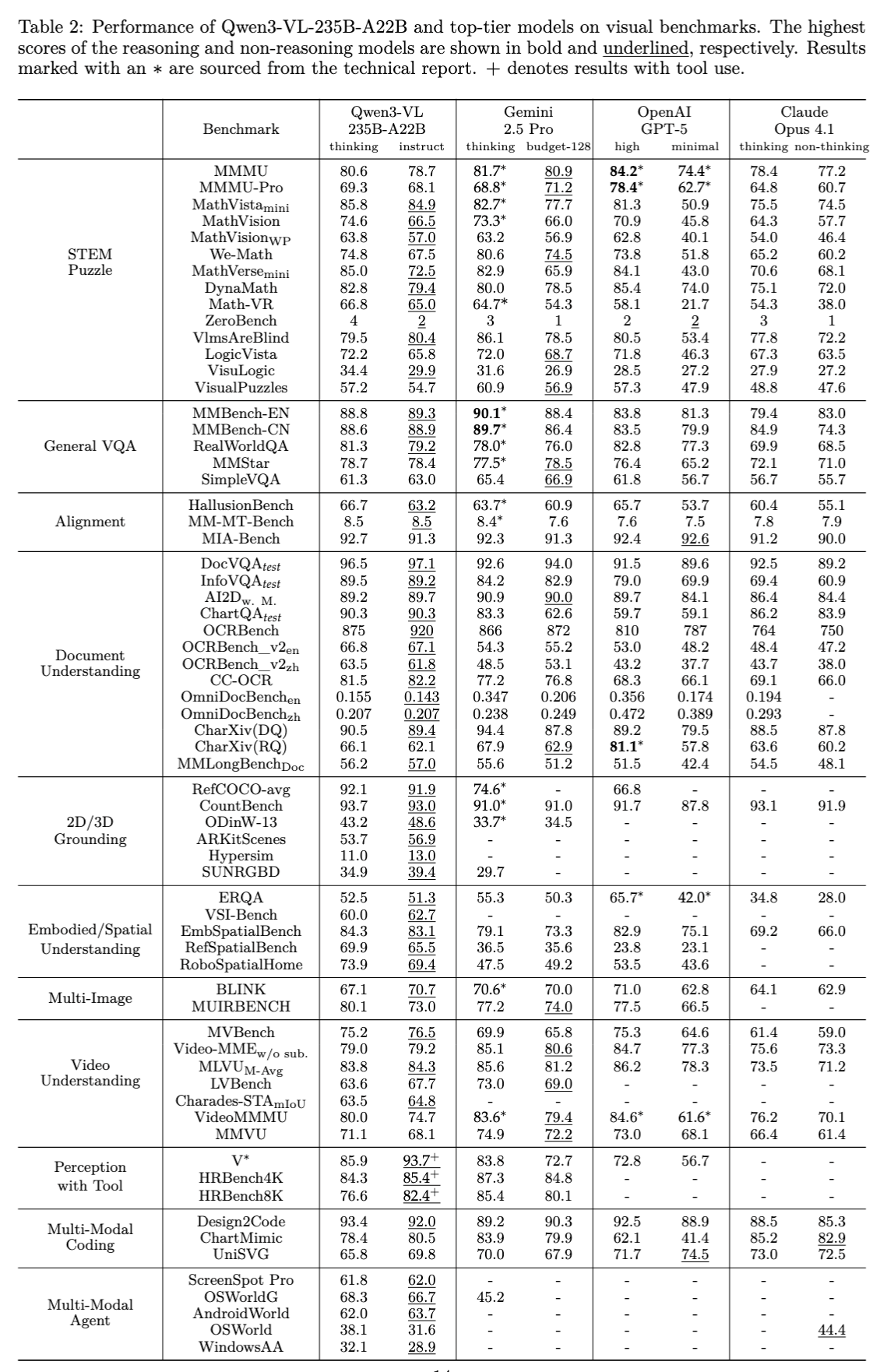

5. 实验评估

实验在多个维度上对比了 Qwen3-VL 与 GPT-5 (OpenAI), Gemini 2.5 Pro (Google), Claude Opus 4.1 (Anthropic) 等模型。

5.1 通用视觉问答 (General VQA)

在 MMBench, RealWorldQA, MMStar 等基准上,Qwen3-VL 系列表现强劲。

-

旗舰模型: Qwen3-VL-235B-A22B-Instruct 在 MMBench-EN 上达到 89.3,超过了 GPT-5 (High budget) 的 83.8。 -

中等模型: Qwen3-VL-32B 在多个榜单上优于 Gemini 2.5 Flash 和 GPT-5 mini。

5.2 多模态推理

重点评估了 STEM 相关任务(MMMU, MathVista, DynaMath)。

-

思考模式优势: Qwen3-VL-235B-A22B-Thinking 在 MathVista_mini 上达到 82.7,在 MathVerse_mini 上达到 82.9,均优于 Instruct 版本,且在多数任务上超越了 Gemini 2.5 Pro (Thinking)。 -

小模型性能: 即便 Qwen3-VL-8B 也在 DynaMath 上取得了 78.0 的分数,显示出良好的扩展性。

5.3 文档理解与 OCR

评估数据集包括 DocVQA, ChartQA, OCRBench 等。

-

DocVQA: Qwen3-VL-235B-A22B 取得了 97.1 (Instruct) 的高分。 -

多语言 OCR: 在自建的 39 种语言测试集中,模型在 32 种语言上准确率超过 70%。 -

长文档: 在 MMLongBench-Doc 上,Instruct 版本准确率为 57.0%,展示了长上下文训练的有效性。

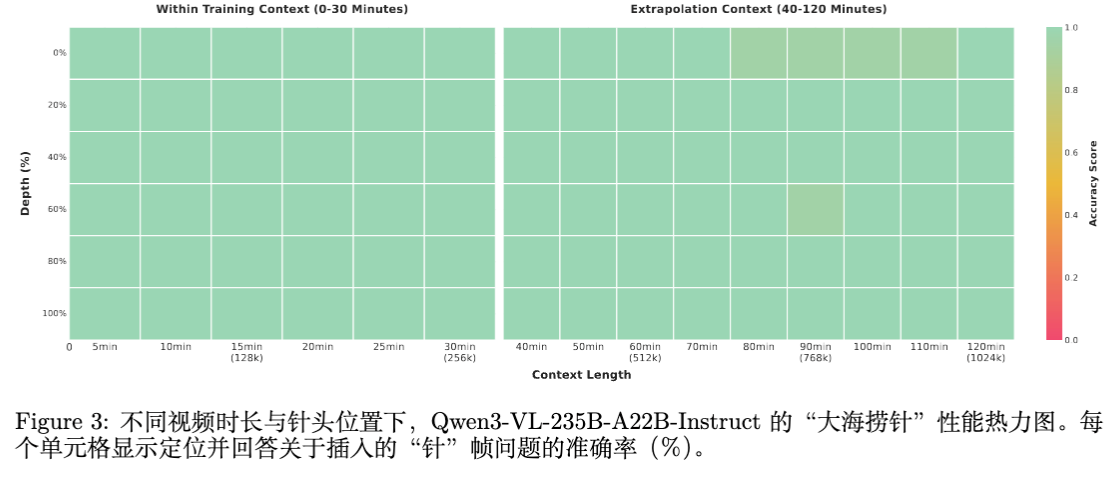

5.4 视频理解

评估涵盖 VideoMME, MVBench, LVBench (长视频) 等。

-

长视频优势: 得益于 256K 上下文和文本时间戳,Qwen3-VL 在 MLVU (长视频理解) 上表现优异。 -

大海捞针 (Needle-in-a-Haystack): 在视频“大海捞针”测试中,模型在 30 分钟视频(256K token)内达到了 100% 的准确率。通过 YaRN 外推至 1M token(约 2 小时视频)时,准确率仍保持在 99.5%。

5.5 Agent 与工具使用

-

GUI Grounding: 在 AndroidWorld 和 OSWorld 上,Qwen3-VL 展现了 SOTA 性能。Qwen3-VL-32B 在 AndroidWorld 上得分 63.7。 -

Fine-grained Perception with Tools: 在 V* 和 HRBench 等需要极高精度的任务上,结合工具使用(Pixel-level grounding tools)后,模型性能有显著提升(例如 V* 上提升约 5 个点)。

6. 消融研究

报告对关键架构选择进行了消融分析:

6.1 视觉编码器选择

对比了 Qwen3-ViT(在 CLIP 阶段使用 1.5T token 训练)和 SigLIP-2。

-

结果: 尽管 Qwen3-ViT 在 ImageNet 等标准分类任务上表现稍好,但在结合 LLM 进行 VLM 训练后,SigLIP-2 在 OmniBench(内部综合评估套件)上的表现更具优势,且训练效率更高。

6.2 DeepStack 的有效性

-

对比: 基线模型(无 DeepStack)vs 集成 DeepStack 的模型。 -

结果: DeepStack 在 InfoVQA, DocVQA, ChartQA 等需要细粒度视觉信息的任务上带来了显著提升(例如 DocVQA 从 89.5 提升至 91.1)。这证明了注入中间层视觉特征能有效补充高层语义特征的不足。

7. 结论与展望

Qwen3-VL 技术报告展示了当前视觉-语言模型的前沿水平。通过架构上的微创新(Interleaved-MRoPE, DeepStack)、激进的数据工程(特别是合成数据和长上下文数据)以及引入 System 2 风格的思考模式,Qwen3-VL 在保持文本能力的同时,大幅提升了多模态推理和长窗口理解能力。

未来的工作方向包括:

-

交互式感知: 增强模型在动态环境中主动感知和调整的能力。 -

实时多模态控制: 迈向实时机器人控制和操作。 -

理解与生成的统一: 探索利用视觉生成能力来反哺视觉理解,构建统一架构。

更多细节请阅读原技术报告。

往期文章: