30

2025/08

上交 & 上海 AILAB 提出 Memory Decoder:一种用于大语言模型的免微调即插即用记忆模块

大型语言模型(LLMs)在处理通用语言任务时展现了强大的能力,但在将它们应用于特定专业领域时,仍然面临挑战。当前主流的领域自适应方法主要有两种:领域自适应预训

...

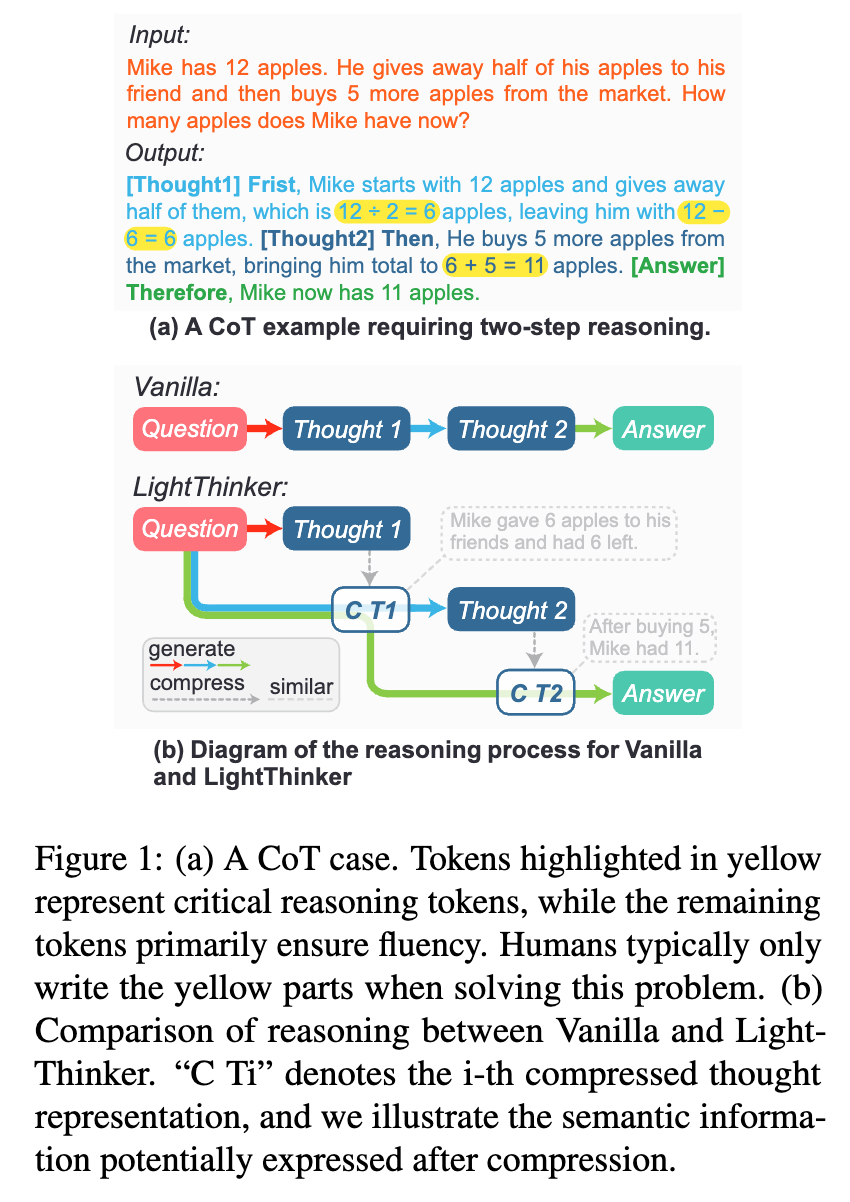

EMNLP2025 浙大&蚂蚁提出 LightThinker:动态压缩CoT提升推理效率

推理模型详细的推理步骤意味着更长的输出序列,这给基于 Transformer 架构的 LLM 带来了巨大的内存和计算压力。具体来说,注意力机制的计算成本会随着

...